امروز، ما با هیجان اعلام می کنیم که مدل های پایه Mistral 7B که توسط Mistral AI توسعه یافته است، برای مشتریان در دسترس هستند. Amazon SageMaker JumpStart برای استقرار با یک کلیک برای اجرای استنتاج. با 7 میلیارد پارامتر، Mistral 7B را می توان به راحتی سفارشی کرد و به سرعت مستقر کرد. میتوانید این مدل را با SageMaker JumpStart امتحان کنید، یک مرکز یادگیری ماشین (ML) که دسترسی به الگوریتمها و مدلها را فراهم میکند تا بتوانید به سرعت با ML شروع کنید. در این پست به نحوه کشف و استقرار مدل Mistral 7B می پردازیم.

Mistral 7B چیست؟

Mistral 7B یک مدل پایه است که توسط Mistral AI توسعه یافته و از توانایی های تولید متن و کد انگلیسی پشتیبانی می کند. از انواع موارد استفاده مانند خلاصه سازی متن، طبقه بندی، تکمیل متن و تکمیل کد پشتیبانی می کند. برای نشان دادن قابلیت سفارشیسازی آسان مدل، Mistral AI مدل Mistral 7B Instruct را نیز برای موارد استفاده از چت منتشر کرده است که با استفاده از مجموعههای دادههای مکالمه در دسترس عموم بهخوبی تنظیم شده است.

Mistral 7B یک مدل ترانسفورماتور است و از توجه جستجوی گروهی و توجه پنجره کشویی برای دستیابی به استنتاج سریعتر (تأخیر کم) و مدیریت توالی های طولانی تر استفاده می کند. توجه پرس و جو گروهی معماری است که توجه چند پرس و جو و چند سر را برای دستیابی به کیفیت خروجی نزدیک به توجه چند سر و سرعت قابل مقایسه با توجه چند پرس و جو ترکیب می کند. توجه پنجره کشویی از لایههای انباشته یک ترانسفورماتور برای حضور در گذشته فراتر از اندازه پنجره برای افزایش طول زمینه استفاده میکند. Mistral 7B دارای طول زمینه 8,000 توکن است، تأخیر کم و توان عملیاتی بالا را نشان میدهد و در مقایسه با مدلهای جایگزین بزرگتر، عملکرد قوی دارد و نیازهای حافظه کم را در اندازه مدل 7B فراهم میکند. این مدل تحت مجوز در دسترس است مجوز Apache 2.0، برای استفاده بدون محدودیت.

SageMaker JumpStart چیست؟

با SageMaker JumpStart، پزشکان ML میتوانند از بین فهرست رو به رشدی از بهترین مدلهای فونداسیون انتخاب کنند. پزشکان ML می توانند مدل های پایه را به صورت اختصاصی به کار گیرند آمازون SageMaker نمونه هایی در یک محیط جدا شده از شبکه، و سفارشی کردن مدل ها با استفاده از SageMaker برای آموزش و استقرار مدل.

اکنون میتوانید Mistral 7B را با چند کلیک کشف و اجرا کنید Amazon SageMaker Studio یا به صورت برنامه نویسی از طریق SageMaker Python SDK، به شما امکان می دهد عملکرد مدل و کنترل های MLOps را با ویژگی های SageMaker مانند خطوط لوله آمازون SageMaker, دیباگر Amazon SageMaker، یا سیاهههای مربوط به کانتینر. این مدل در یک محیط امن AWS و تحت کنترل های VPC شما مستقر شده است و به اطمینان از امنیت داده ها کمک می کند.

مدل ها را کشف کنید

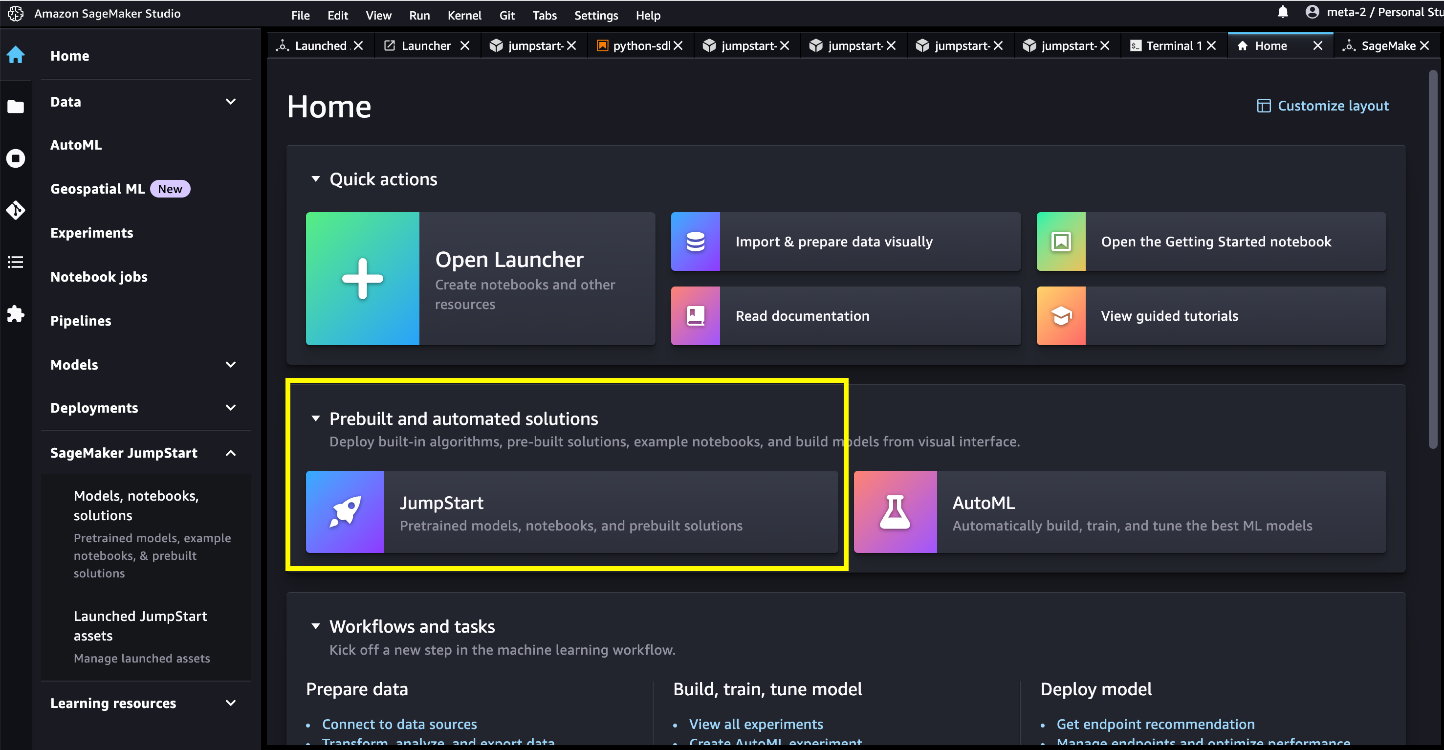

میتوانید از طریق SageMaker JumpStart در SageMaker Studio UI و SageMaker Python SDK به مدلهای پایه Mistral 7B دسترسی پیدا کنید. در این بخش به نحوه کشف مدل ها در SageMaker Studio می پردازیم.

SageMaker Studio یک محیط توسعه یکپارچه (IDE) است که یک رابط بصری مبتنی بر وب را فراهم می کند که در آن می توانید به ابزارهای ساخته شده برای انجام تمام مراحل توسعه ML، از آماده سازی داده ها تا ساخت، آموزش، و استقرار مدل های ML خود دسترسی داشته باشید. برای جزئیات بیشتر در مورد نحوه شروع و راه اندازی SageMaker Studio، مراجعه کنید Amazon SageMaker Studio.

در SageMaker Studio، میتوانید به SageMaker JumpStart دسترسی داشته باشید که شامل مدلهای از پیش آموزشدیده، نوتبوکها و راهحلهای از پیش ساخته شده است. راه حل های از پیش ساخته شده و خودکار.

از صفحه فرود SageMaker JumpStart، می توانید راه حل ها، مدل ها، نوت بوک ها و منابع دیگر را جستجو کنید. شما میتوانید Mistral 7B را در آن پیدا کنید مدل های بنیاد: تولید متن چرخ فلک.

شما همچنین می توانید مدل های دیگر را با انتخاب پیدا کنید تمام مدل های متنی را کاوش کنید یا جستجوی «Mistral»

میتوانید کارت مدل را برای مشاهده جزئیات مدل مانند مجوز، دادههای مورد استفاده برای آموزش و نحوه استفاده انتخاب کنید. همچنین دو دکمه پیدا خواهید کرد، گسترش و نوت بوک را باز کنید، که به شما در استفاده از مدل کمک می کند (عکس صفحه زیر نشان می دهد گسترش گزینه).

استقرار مدلها

استقرار با انتخاب شما شروع می شود گسترش. از طرف دیگر، میتوانید از طریق دفترچه یادداشت مثالی که هنگام انتخاب نشان داده میشود، استفاده کنید نوت بوک را باز کنید. دفترچه یادداشت نمونه راهنمایی سرتاسری در مورد نحوه استقرار مدل برای استنتاج و پاکسازی منابع ارائه می دهد.

برای استقرار با استفاده از نوت بوک، با انتخاب مدل Mistral 7B، مشخص شده توسط model_id. می توانید هر یک از مدل های انتخاب شده را با کد زیر در SageMaker مستقر کنید:

این مدل را با پیکربندیهای پیشفرض، از جمله نوع نمونه پیشفرض (ml.g5.2xlarge) و پیکربندیهای پیشفرض VPC، در SageMaker مستقر میکند. شما می توانید این تنظیمات را با تعیین مقادیر غیر پیش فرض در آن تغییر دهید JumpStartModel. پس از استقرار، می توانید استنتاج را در برابر نقطه پایانی مستقر شده از طریق پیش بینی SageMaker اجرا کنید:

بهینه سازی پیکربندی استقرار

مدلهای میسترال از سرویس مدل استنتاج نسل متن (TGI نسخه 1.1) استفاده میکنند. هنگام استقرار مدلها با ظرف یادگیری عمیق TGI (DLC)، میتوانید انواع مختلفی را پیکربندی کنید آرگومان های پرتاب کننده از طریق متغیرهای محیطی هنگام استقرار نقطه پایانی خود. SageMaker JumpStart برای پشتیبانی از طول زمینه 8,000 توکن مدل های Mistral 7B، برخی از این پارامترها را به طور پیش فرض پیکربندی کرده است: ما تنظیم کردیم MAX_INPUT_LENGTH و MAX_TOTAL_TOKENS به ترتیب به 8191 و 8192 رسید. با بررسی شی مدل خود می توانید لیست کامل را مشاهده کنید:

به طور پیش فرض، SageMaker JumpStart کاربران همزمان را از طریق متغیر محیطی گیر نمی کند. MAX_CONCURRENT_REQUESTS کوچکتر از مقدار پیشفرض TGI 128. دلیل آن این است که برخی از کاربران ممکن است بارهای کاری معمولی با طول زمینه محموله کوچک داشته باشند و خواهان همزمانی بالا باشند. توجه داشته باشید که SageMaker TGI DLC از چندین کاربر همزمان از طریق Rolling Batch پشتیبانی می کند. هنگام استقرار نقطه پایانی خود برای برنامه خود، ممکن است در نظر بگیرید که آیا باید clamp کنید یا خیر MAX_TOTAL_TOKENS or MAX_CONCURRENT_REQUESTS قبل از استقرار برای ارائه بهترین عملکرد برای حجم کاری:

در اینجا، نشان میدهیم که چگونه عملکرد مدل ممکن است برای بار کاری نقطه پایانی معمولی شما متفاوت باشد. در جداول زیر می توانید مشاهده کنید که پرس و جوهای کوچک (128 کلمه ورودی و 128 نشانه خروجی) در تعداد زیادی از کاربران همزمان کاملاً کارآمد هستند و به توان عملیاتی توکن در مرتبه 1,000 توکن در ثانیه می رسند. با این حال، وقتی تعداد کلمات ورودی به 512 کلمه ورودی افزایش مییابد، نقطه پایانی ظرفیت دستهای خود را اشباع میکند - تعداد درخواستهای همزمان مجاز به پردازش همزمان - که منجر به یک فلات توان و کاهش تاخیر قابل توجهی میشود که از حدود 16 کاربر همزمان شروع میشود. در نهایت، هنگام پرس و جو از نقطه پایانی با زمینه های ورودی بزرگ (به عنوان مثال، 6,400 کلمه) به طور همزمان توسط چندین کاربر همزمان، این پلاتو گذرگاه نسبتاً سریع رخ می دهد، تا جایی که حساب SageMaker شما شروع به مواجهه با محدودیت های زمان پاسخ 60 ثانیه ای برای درخواست های بیش از حد شما می کند. .

| . | توان عملیاتی (توکن/ها) | ||||||||||

| کاربران همزمان | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| مدل | نوع نمونه | کلمات ورودی | توکن های خروجی | . | |||||||

| mistral-7b-instruct | ml.g5.2xlarge | 128 | 128 | 30 | 54 | 89 | 166 | 287 | 499 | 793 | 1030 |

| 512 | 128 | 29 | 50 | 80 | 140 | 210 | 315 | 383 | 458 | ||

| 6400 | 128 | 17 | 25 | 30 | 35 | - | - | - | - | ||

| . | تأخیر p50 (ms/token) | ||||||||||

| کاربران همزمان | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| مدل | نوع نمونه | کلمات ورودی | توکن های خروجی | . | |||||||

| mistral-7b-instruct | ml.g5.2xlarge | 128 | 128 | 32 | 33 | 34 | 36 | 41 | 46 | 59 | 88 |

| 512 | 128 | 34 | 36 | 39 | 43 | 54 | 71 | 112 | 213 | ||

| 6400 | 128 | 57 | 71 | 98 | 154 | - | - | - | - | ||

استنتاج و اعلانات مثال

Mistral 7B

میتوانید با یک مدل پایه Mistral 7B مانند هر مدل استاندارد تولید متن تعامل کنید، که در آن مدل یک توالی ورودی را پردازش میکند و کلمات بعدی پیشبینیشده در دنباله را خروجی میدهد. در زیر یک مثال ساده با یادگیری چند شات است، که در آن مدل با چندین مثال ارائه شده و پاسخ نمونه نهایی با دانش متنی این مثالهای قبلی تولید میشود:

دستور Mistral 7B

نسخه تنظیمشده با دستورالعمل Mistral دستورالعملهای قالببندی شده را میپذیرد که در آن نقشهای مکالمه باید با یک فرمان کاربر شروع شود و بین کاربر و دستیار جایگزین شود. یک فرمان ساده کاربر ممکن است به شکل زیر باشد:

یک اعلان چند دور به شکل زیر خواهد بود:

این الگو برای هر چند نوبت در مکالمه تکرار می شود.

در بخشهای بعدی، نمونههایی را با استفاده از مدل Mistral 7B Instruct بررسی میکنیم.

بازیابی دانش

مثال زیر نمونه ای از بازیابی دانش است:

پاسخ به سوال زمینه بزرگ

برای نشان دادن نحوه استفاده از این مدل برای پشتیبانی از طول زمینه ورودی بزرگ، مثال زیر بخشی را با عنوان "Rats" توسط رابرت سالیوان تعبیه می کند.مرجع)، از آزمون درک مطلب خواندنی هنرهای زبان انگلیسی کلاس 10 MCAS به دستورالعمل اعلان ورودی وارد می شود و از مدل یک سوال هدایت شده در مورد متن می پرسد:

ریاضیات و استدلال

مدلهای Mistral همچنین نقاط قوت را در دقت ریاضیات گزارش میکنند. میسترال میتواند درکی مانند منطق ریاضی زیر را ارائه دهد:

برنامه نویسی

در زیر نمونه ای از اعلان کدنویسی آمده است:

پاک کردن

پس از اتمام اجرای نوت بوک، مطمئن شوید که تمام منابعی را که در این فرآیند ایجاد کرده اید حذف کرده اید تا صورتحساب شما متوقف شود. از کد زیر استفاده کنید:

نتیجه

در این پست به شما نشان دادیم که چگونه میتوان با Mistral 7B در SageMaker Studio شروع کرد و مدل را برای استنباط به کار برد. از آنجایی که مدل های فونداسیون از قبل آموزش دیده اند، می توانند به کاهش هزینه های آموزش و زیرساخت کمک کنند و سفارشی سازی را برای موارد استفاده شما امکان پذیر کنند. بازدید کنید Amazon SageMaker JumpStart اکنون برای شروع

منابع

درباره نویسنده

دکتر کایل اولریش یک دانشمند کاربردی با تیم آمازون SageMaker JumpStart است. علایق تحقیقاتی او شامل الگوریتم های یادگیری ماشین مقیاس پذیر، بینایی کامپیوتر، سری های زمانی، ناپارامتریک های بیزی و فرآیندهای گاوسی است. دکترای او از دانشگاه دوک است و مقالاتی در NeurIPS، Cell و Neuron منتشر کرده است.

دکتر کایل اولریش یک دانشمند کاربردی با تیم آمازون SageMaker JumpStart است. علایق تحقیقاتی او شامل الگوریتم های یادگیری ماشین مقیاس پذیر، بینایی کامپیوتر، سری های زمانی، ناپارامتریک های بیزی و فرآیندهای گاوسی است. دکترای او از دانشگاه دوک است و مقالاتی در NeurIPS، Cell و Neuron منتشر کرده است.

دکتر آشیش ختان یک دانشمند ارشد کاربردی با Amazon SageMaker JumpStart است و به توسعه الگوریتم های یادگیری ماشین کمک می کند. او دکترای خود را از دانشگاه ایلینویز Urbana-Champaign گرفت. او یک محقق فعال در یادگیری ماشین و استنتاج آماری است و مقالات زیادی در کنفرانس های NeurIPS، ICML، ICLR، JMLR، ACL و EMNLP منتشر کرده است.

دکتر آشیش ختان یک دانشمند ارشد کاربردی با Amazon SageMaker JumpStart است و به توسعه الگوریتم های یادگیری ماشین کمک می کند. او دکترای خود را از دانشگاه ایلینویز Urbana-Champaign گرفت. او یک محقق فعال در یادگیری ماشین و استنتاج آماری است و مقالات زیادی در کنفرانس های NeurIPS، ICML، ICLR، JMLR، ACL و EMNLP منتشر کرده است.

ویوک سینگ مدیر محصول با Amazon SageMaker JumpStart است. او بر روی قادر ساختن مشتریان به SageMaker JumpStart تمرکز می کند تا سفر ML خود را برای ساختن برنامه های کاربردی هوش مصنوعی ساده و تسریع بخشند.

ویوک سینگ مدیر محصول با Amazon SageMaker JumpStart است. او بر روی قادر ساختن مشتریان به SageMaker JumpStart تمرکز می کند تا سفر ML خود را برای ساختن برنامه های کاربردی هوش مصنوعی ساده و تسریع بخشند.

روی آللا یک معمار ارشد راه حل های تخصصی AI/ML در AWS مستقر در مونیخ، آلمان است. روی به مشتریان AWS - از استارتآپهای کوچک گرفته تا شرکتهای بزرگ - کمک میکند تا مدلهای زبان بزرگ را بهطور کارآمد در AWS آموزش داده و به کار گیرند. روی مشتاق مشکلات بهینهسازی محاسباتی و بهبود عملکرد بارهای کاری هوش مصنوعی است.

روی آللا یک معمار ارشد راه حل های تخصصی AI/ML در AWS مستقر در مونیخ، آلمان است. روی به مشتریان AWS - از استارتآپهای کوچک گرفته تا شرکتهای بزرگ - کمک میکند تا مدلهای زبان بزرگ را بهطور کارآمد در AWS آموزش داده و به کار گیرند. روی مشتاق مشکلات بهینهسازی محاسباتی و بهبود عملکرد بارهای کاری هوش مصنوعی است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/mistral-7b-foundation-models-from-mistral-ai-are-now-available-in-amazon-sagemaker-jumpstart/