نویسنده: ویتالیک بوترین از طریق وبلاگ ویتالیک بوترین

تشکر ویژه از تیم Worldcoin و Modulus Labs، Xinyuan Sun، Martin Koeppelmann و Illia Polosukhin برای بازخورد و بحث.

بسیاری از مردم در طول سال ها از من سؤال مشابهی پرسیده اند: چیست؟ تقاطع بین کریپتو و هوش مصنوعی که به نظر من پربارترین است؟ این یک سوال منطقی است: رمزنگاری و هوش مصنوعی دو روند اصلی فناوری عمیق (نرمافزاری) دهه گذشته هستند، و به نظر میرسد که وجود دارد. باید نوعی ارتباط بین این دو باشد. دستیابی به هم افزایی در سطح فضای سطحی آسان است: تمرکززدایی ارزهای دیجیتال می تواند تمرکز هوش مصنوعی را متعادل کنید، هوش مصنوعی غیرشفاف است و رمزنگاری شفافیت را به ارمغان می آورد، هوش مصنوعی به داده ها نیاز دارد و بلاک چین ها برای ذخیره و ردیابی داده ها خوب هستند. اما در طول سالها، زمانی که مردم از من میخواستند سطحی عمیقتر بکنم و در مورد برنامههای کاربردی خاص صحبت کنم، پاسخ من ناامیدکننده بود: "بله چیزهای کمی وجود دارد اما نه آنقدر".

در سه سال گذشته، با ظهور هوش مصنوعی بسیار قدرتمندتر در قالب مدرن LLMsو ظهور کریپتوهای بسیار قدرتمندتر نه تنها در قالب راه حل های مقیاس بندی بلاک چین، بلکه همچنین ZKP ها, FHE، (دو حزبی و غیر حزبی) MPC، من شروع به دیدن این تغییر کرده ام. در واقع برخی از کاربردهای امیدوارکننده هوش مصنوعی در داخل اکوسیستم های زنجیره بلوکی وجود دارد هوش مصنوعی همراه با رمزنگاری، اگرچه مهم است که مراقب نحوه اعمال هوش مصنوعی باشیم. یک چالش خاص این است: در رمزنگاری، منبع باز تنها راه برای ایجاد امنیت واقعی است، اما در هوش مصنوعی، یک مدل (یا حتی داده های آموزشی آن) باز است. بسیار افزایش می یابد آسیب پذیری آن به یادگیری ماشینی متخاصم حملات این پست از طریق طبقهبندی روشهای مختلفی که رمزنگاری + هوش مصنوعی میتوانند تلاقی کنند، و چشماندازها و چالشهای هر دسته را بررسی میکند.

چهار دسته اصلی

هوش مصنوعی یک مفهوم بسیار گسترده است: شما می توانید "AI" را مجموعه ای از الگوریتم هایی تصور کنید که نه با مشخص کردن صریح آنها، بلکه با هم زدن یک سوپ محاسباتی بزرگ و ایجاد نوعی فشار بهینه سازی ایجاد می کنید که سوپ را به سمت سوپ سوق می دهد. تولید الگوریتم هایی با ویژگی های مورد نظر شما این توصیف را قطعاً نباید نادیده گرفت: آن شامل la روند که ایجاد شده در وهله اول ما انسان ها! اما این بدان معناست که الگوریتمهای هوش مصنوعی دارای برخی ویژگیهای مشترک هستند: توانایی آنها برای انجام کارهایی که بسیار قدرتمند هستند، همراه با محدودیتهایی در توانایی ما برای دانستن یا درک آنچه در زیر سرپوش میگذرد.

راه های زیادی برای طبقه بندی هوش مصنوعی وجود دارد. برای اهداف این پست، که در مورد تعاملات بین هوش مصنوعی و بلاک چین ها (که به عنوان یک پلت فرم برای ایجاد "بازی"، من آن را به شرح زیر دسته بندی می کنم:

- هوش مصنوعی به عنوان بازیکن در یک بازی [بالاترین قابلیت زنده ماندن]: هوش مصنوعی در مکانیسمهایی شرکت میکند که منبع نهایی مشوقها از پروتکلی با ورودیهای انسانی میآید.

- هوش مصنوعی به عنوان یک رابط برای بازی [پتانسیل بالا، اما با خطر]: هوش مصنوعی به کاربران کمک می کند تا دنیای رمزارزهای اطراف خود را درک کنند و اطمینان حاصل کنند که رفتار آنها (یعنی پیام ها و تراکنش های امضا شده) با اهداف آنها مطابقت دارد و فریب یا کلاهبرداری نمی شوند.

- هوش مصنوعی به عنوان قوانین بازی [با دقت قدم بردارید]: بلاک چین ها، DAO ها و مکانیسم های مشابه که مستقیماً به هوش مصنوعی فراخوانی می کنند. فکر کنید مثلا "قضات هوش مصنوعی"

- هوش مصنوعی به عنوان هدف بازی [دراز مدت اما جذاب]: طراحی بلاک چین، DAO و مکانیسمهای مشابه با هدف ساخت و نگهداری یک هوش مصنوعی که میتواند برای مقاصد دیگر مورد استفاده قرار گیرد، با استفاده از بیتهای کریپتو یا برای ایجاد انگیزه بهتر در آموزش یا جلوگیری از افشای دادههای خصوصی یا سوء استفاده هوش مصنوعی.

بگذارید اینها را یکی یکی مرور کنیم.

هوش مصنوعی به عنوان یک بازیکن در یک بازی

این در واقع مقوله ای است که برای نزدیک به یک دهه، حداقل از آن زمان وجود داشته است صرافی های غیرمتمرکز زنجیره ای (DEX) شروع به استفاده قابل توجهی کرد. هر زمان مبادله ای وجود دارد، فرصتی برای کسب درآمد از طریق آربیتراژ وجود دارد و ربات ها می توانند بسیار بهتر از انسان ها آربیتراژ انجام دهند. این مورد استفاده برای مدت طولانی وجود داشته است، حتی با هوش مصنوعی بسیار ساده تر از آنچه امروز داریم، اما در نهایت این یک تقاطع AI + رمزنگاری بسیار واقعی است. اخیرا، ربات های آربیتراژ MEV را دیده ایم اغلب از یکدیگر استثمار می کنند. هر زمان که یک برنامه بلاک چین دارید که شامل حراج یا تجارت است، ربات های آربیتراژ خواهید داشت.

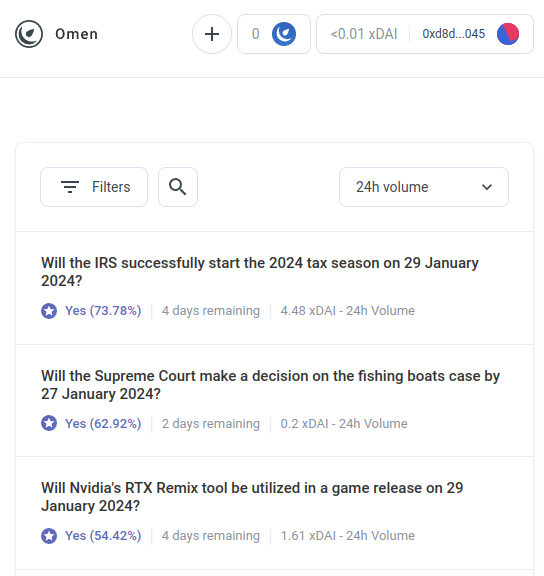

اما رباتهای آربیتراژ هوش مصنوعی تنها اولین نمونه از یک دسته بسیار بزرگتر هستند، که من انتظار دارم به زودی شامل بسیاری از برنامههای کاربردی دیگر شود. ملاقات با AIOmen، a نسخه ی نمایشی یک بازار پیش بینی که در آن هوش مصنوعی بازیگر است:

یکی از پاسخها به این موضوع اشاره به پیشرفتهای UX در حال انجام است چند بازار یا دیگر بازارهای پیش بینی جدید، و امیدواریم که در جایی که تکرارهای قبلی شکست خورده اند، موفق شوند. به هر حال، داستان از این قرار است، مردم مایل به شرط بندی هستند ده ها میلیارد برای ورزش، پس چرا مردم به اندازه کافی برای انتخابات ایالات متحده شرط بندی نمی کنند LK99 اینکه ورود بازیکنان جدی شروع به منطقی می کند؟ اما این استدلال باید با این واقعیت مخالفت کند که خوب، تکرارهای قبلی داشته باشد نتوانستند به این سطح از مقیاس برسند (حداقل در مقایسه با رویاهای طرفداران آنها)، و بنابراین به نظر می رسد که شما نیاز دارید یک چیز جدید تا بازارهای پیش بینی موفق شوند. و بنابراین، یک پاسخ متفاوت اشاره به یک ویژگی خاص از اکوسیستمهای بازار پیشبینی است که میتوانیم انتظار داشته باشیم در دهه 2020 شاهد آن باشیم که در دهه 2010 شاهد آن نبودیم: امکان مشارکت همه جانبه توسط هوش مصنوعی.

هوش مصنوعی ها مایلند کمتر از 1 دلار در ساعت کار کنند و دانش یک دانشنامه را دارند - و اگر این کافی نباشد، حتی می توانند با قابلیت جستجوی وب در زمان واقعی ادغام شوند. اگر بازاری بسازید و 50 دلار یارانه نقدینگی بدهید، انسانها به اندازه کافی برای پیشنهاد دادن اهمیتی نمیدهند، اما هزاران هوش مصنوعی به راحتی در سراسر این سوال ازدحام میکنند و بهترین حدس را میزنند. انگیزه انجام یک کار خوب در مورد هر سوالی ممکن است ناچیز باشد، اما انگیزه ایجاد یک هوش مصنوعی که پیش بینی های خوبی انجام دهد. در عمومی ممکن است در میلیون ها باشد. توجه داشته باشید که به طور بالقوه، شما حتی نیازی به انسان برای قضاوت در اکثر سوالات ندارید: می توانید از سیستم اختلاف چند دور مشابه استفاده کنید پیش بینی کردن یا Kleros، که در آن هوش مصنوعی نیز کسانی هستند که در دورهای قبلی شرکت می کنند. انسانها فقط در موارد معدودی که یک سری تنشها رخ داده و مقادیر زیادی پول توسط هر دو طرف متعهد شدهاند، باید پاسخ دهند.

این یک بدوی قدرتمند است، زیرا هنگامی که بتوان یک «بازار پیشبینی» را برای کار در چنین مقیاس میکروسکوپی ایجاد کرد، میتوان از «بازار پیشبینی» اولیه برای بسیاری از انواع سؤالات دیگر استفاده کرد:

- آیا این پست رسانه اجتماعی تحت [شرایط استفاده] قابل قبول است؟

- چه اتفاقی برای قیمت سهام X خواهد افتاد (مثلاً ببینید نومرای)

- آیا این اکانتی که در حال حاضر به من پیام می دهد واقعاً ایلان ماسک است؟

- آیا این ارسال کار در یک بازار کار آنلاین قابل قبول است؟

- آیا dapp در https://examplefinance.network کلاهبرداری است؟

- Is

0x1b54....98c3در واقع آدرس توکن "Casinu Inu" ERC20؟

ممکن است متوجه شوید که بسیاری از این ایدهها در جهت همان چیزی است که من نام بردم.دفاع از اطلاعات" که در . با تعریف کلی، سوال این است: چگونه به کاربران کمک کنیم تا اطلاعات درست و نادرست را تشخیص دهند و کلاهبرداری ها را شناسایی کنند، بدون اینکه یک مرجع متمرکز برای تصمیم گیری درست و نادرست که ممکن است از آن موقعیت سوء استفاده کند، قدرت دهیم؟ در سطح خرد، پاسخ می تواند "AI" باشد. اما در سطح کلان، سوال این است: چه کسی هوش مصنوعی را میسازد؟ هوش مصنوعی انعکاسی از فرآیندی است که آن را ایجاد کرده است و بنابراین نمی تواند از تعصبات جلوگیری کند. از این رو، نیاز به یک بازی سطح بالاتری وجود دارد که میزان عملکرد هوش مصنوعی های مختلف را تعیین کند، جایی که هوش مصنوعی می تواند به عنوان بازیکن در بازی شرکت کند..

این استفاده از هوش مصنوعی، که در آن هوش مصنوعی در مکانیزمی شرکت میکند که در نهایت توسط یک مکانیسم زنجیرهای که ورودیها را از انسان جمعآوری میکند (به آن مبتنی بر بازار نامتمرکز میگویند) پاداش میگیرند یا جریمه میشوند. RLHF؟)، چیزی است که فکر می کنم واقعا ارزش بررسی آن را دارد. اکنون زمان مناسبی است که موارد استفاده از این قبیل را بیشتر بررسی کنیم، زیرا مقیاس بندی بلاک چین در نهایت موفقیت آمیز است، و هر چیزی را در نهایت در زنجیره ای قابل دوام می کند در حالی که اغلب قبلاً نبود.

دستهبندی مرتبط از برنامهها در جهت عوامل بسیار مستقل هستند استفاده از بلاک چین برای همکاری بهترچه از طریق پرداخت و چه از طریق استفاده از قراردادهای هوشمند برای انجام تعهدات معتبر.

هوش مصنوعی به عنوان رابطی برای بازی

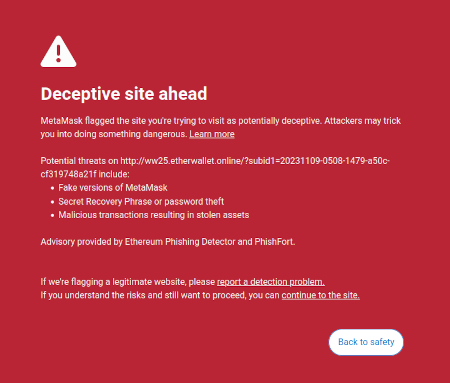

یک ایده که من در ذهنم مطرح کردم نوشته های روی این ایده است که فرصتی در بازار برای نوشتن نرمافزاری برای کاربر وجود دارد که با تفسیر و شناسایی خطرات در دنیای آنلاین که کاربر در حال حرکت است، از منافع کاربران محافظت کند. یکی از نمونههای موجود در این مورد، ویژگی تشخیص کلاهبرداری متامسک است:

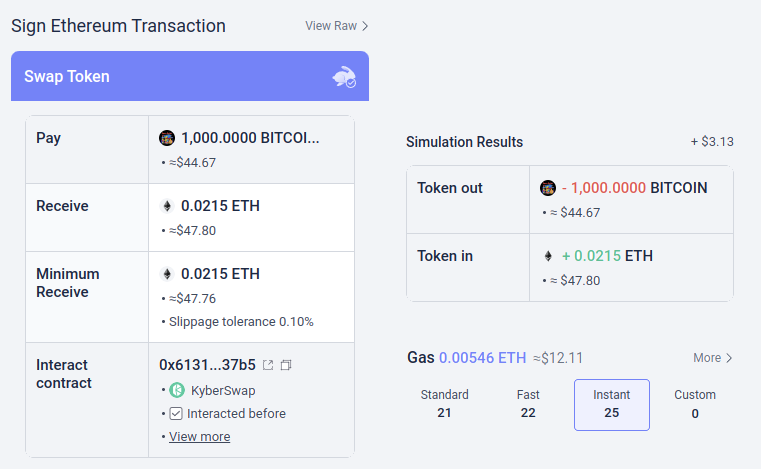

به طور بالقوه، این نوع ابزارها می توانند با هوش مصنوعی فوق العاده شارژ شوند. هوش مصنوعی میتواند توضیحی بسیار غنیتر انساندوستانه در مورد اینکه در چه نوع برنامهای شرکت میکنید، عواقب عملیات پیچیدهتری که امضا میکنید، خواه یک توکن خاص واقعی باشد یا نه (به عنوان مثال. BITCOIN این فقط یک رشته کاراکتر نیست، بلکه نام یک ارز دیجیتال واقعی است که یک توکن ERC20 نیست و قیمت آن بسیار بالاتر از 0.045 دلار است و یک LLM مدرن این را می داند) و غیره. پروژه هایی وجود دارند که در این راستا شروع به پیشرفت می کنند (مثلاً کیف پول LangChain، که از هوش مصنوعی به عنوان یک اصلی رابط). نظر من این است که رابطهای هوش مصنوعی خالص در حال حاضر بسیار پرخطر هستند زیرا این خطر را افزایش میدهد دیگر انواع خطاها، اما هوش مصنوعی تکمیل کننده یک رابط معمولی تر بسیار قابل اجرا است.

یک خطر خاص وجود دارد که باید به آن اشاره کرد. در بخش "هوش مصنوعی به عنوان قواعد بازی" در زیر بیشتر به این موضوع خواهم پرداخت، اما مسئله کلی یادگیری ماشینی متخاصم است: اگر کاربر به یک دستیار هوش مصنوعی در داخل یک کیف پول منبع باز دسترسی داشته باشد، افراد بد به آن دستیار هوش مصنوعی نیز دسترسی خواهند داشت، و بنابراین فرصت نامحدودی برای بهینه سازی کلاهبرداری های خود خواهند داشت تا راه اندازی نشود. دفاعیات آن کیف پول. همه هوش مصنوعی های مدرن در جایی باگ دارند، و برای یک فرآیند آموزشی خیلی سخت نیست، حتی یکی با دسترسی محدود به مدل، برای پیدا کردن آنها.

اینجاست که «هوش مصنوعی شرکتکننده در بازارهای خرد زنجیرهای» بهتر عمل میکند: هر هوش مصنوعی در برابر خطرات یکسانی آسیبپذیر است، اما شما عمداً یک اکوسیستم باز از دهها نفر ایجاد میکنید که دائماً آنها را تکرار میکنند و به طور مداوم بهبود میبخشند. علاوه بر این، هر هوش مصنوعی بسته است: امنیت سیستم ناشی از باز بودن قوانین آن است بازی، نه عملکرد داخلی هر کدام بازیکن.

خلاصه: هوش مصنوعی میتواند به کاربران در درک آنچه در حال وقوع است به زبان ساده کمک کند، میتواند به عنوان یک آموزگار در زمان واقعی عمل کند، میتواند از کاربران در برابر اشتباهات محافظت کند، اما هنگام تلاش برای استفاده مستقیم از آن در برابر اطلاعات غلط و کلاهبرداران مخرب هشدار داده شود.

هوش مصنوعی به عنوان قواعد بازی

اکنون، به برنامهای میرسیم که بسیاری از مردم در مورد آن هیجانزده هستند، اما به نظر من خطرناکترین آن است و باید بیشترین دقت را در آن رعایت کنیم: چیزی که من هوش مصنوعی را بخشی از قوانین بازی مینامم. این به هیجان در میان نخبگان سیاسی جریان اصلی در مورد "قضات هوش مصنوعی" مرتبط است (مثلاً نگاه کنید به این مقاله در وب سایت "اجلاس سران جهانی دولت")، و مشابه این خواسته ها در برنامه های بلاک چین وجود دارد. اگر یک قرارداد هوشمند مبتنی بر بلاک چین یا یک DAO نیاز به تصمیم گیری ذهنی داشته باشد (مثلاً آیا یک محصول کاری خاص در یک قرارداد کار در ازای استخدام قابل قبول است؟ کدام یک تفسیر درست از قانون اساسی زبان طبیعی مانند Optimism است؟ قانون زنجیرها?)، آیا می توانید یک هوش مصنوعی را به سادگی بخشی از قرارداد یا DAO کنید تا به اجرای این قوانین کمک کند؟

این جایی است یادگیری ماشینی متخاصم چالش بسیار سختی خواهد بود دلیل اصلی دو جمله ای چرا به شرح زیر است:

اگر یک مدل هوش مصنوعی که نقش کلیدی در مکانیزم ایفا می کند بسته شود، نمی توانید عملکرد درونی آن را تأیید کنید و بنابراین بهتر از یک برنامه کاربردی متمرکز نیست. اگر مدل هوش مصنوعی باز باشد، مهاجم میتواند آن را به صورت محلی دانلود و شبیهسازی کند و حملات بسیار بهینهسازی شدهای را برای فریب مدل طراحی کند، و سپس میتواند آن را در شبکه زنده پخش کند.

اکنون، خوانندگان مکرر این وبلاگ (یا ساکنان حوزه رمزارز) ممکن است از قبل از من پیشی بگیرند و فکر کنند: اما صبر کنید! ما شواهد فانتزی دانش صفر و سایر اشکال واقعاً جالب رمزنگاری داریم. مطمئناً میتوانیم جادوی رمزنگاری انجام دهیم و عملکردهای داخلی مدل را پنهان کنیم تا مهاجمان نتوانند حملات را بهینه کنند، اما در عین حال ثابت که مدل به درستی اجرا می شود و با استفاده از یک فرآیند آموزشی معقول بر روی مجموعه معقولی از داده های اساسی ساخته شده است!

به طور معمول، این است کاملا نوع تفکری که من هم در این وبلاگ و هم در نوشته های دیگرم از آن دفاع می کنم. اما در مورد محاسبات مربوط به هوش مصنوعی، دو ایراد عمده وجود دارد:

- سربار رمزنگاری: انجام کاری در داخل یک SNARK (یا MPC یا…) بسیار کمتر از انجام آن در حالت شفاف است. با توجه به اینکه هوش مصنوعی در حال حاضر از نظر محاسباتی بسیار فشرده است، آیا انجام هوش مصنوعی در داخل جعبههای سیاه رمزنگاری حتی از نظر محاسباتی قابل دوام است؟

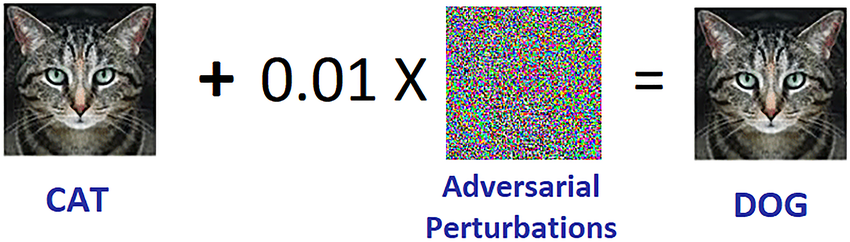

- حملات یادگیری ماشین خصمانه جعبه سیاه: راه هایی برای بهینه سازی حملات علیه مدل های هوش مصنوعی وجود دارد حتی بدون دانستن چیزهای زیادی در مورد عملکرد داخلی مدل و اگر پنهان کنی خیلی زیاد، شما این خطر را دارید که هر کسی که داده های آموزشی را برای خراب کردن مدل انتخاب می کند، بسیار آسان شود مسمومیت حملات.

هر دوی این ها سوراخ های خرگوش پیچیده ای هستند، بنابراین اجازه دهید به نوبه خود وارد هر یک از آنها شویم.

سربار رمزنگاری

ابزارهای رمزنگاری، به ویژه آنهایی که همه منظوره هستند مانند ZK-SNARK و MPC، هزینه بالایی دارند. یک بلوک اتریوم چند صد میلی ثانیه طول می کشد تا یک کلاینت مستقیماً تأیید کند، اما ایجاد یک ZK-SNARK برای اثبات درستی چنین بلوکی می تواند ساعت ها طول بکشد. سربار معمولی دیگر ابزارهای رمزنگاری، مانند MPC، می تواند حتی بدتر باشد. محاسبات هوش مصنوعی در حال حاضر گران است: قدرتمندترین LLM ها می توانند کلمات منفرد را فقط کمی سریعتر از خواندن آنها توسط انسان ها تولید کنند، بدون اینکه به هزینه های محاسباتی اغلب چند میلیون دلاری اشاره کنیم. پرورش مدل ها تفاوت کیفیت بین مدلهای سطح بالا و مدلهایی که سعی در صرفهجویی بیشتر دارند هزینه آموزش or شمارش پارامتر بزرگ است در نگاه اول، این دلیل بسیار خوبی برای مشکوک بودن به کل پروژه تلاش برای افزودن تضمین به هوش مصنوعی با قرار دادن آن در رمزنگاری است.

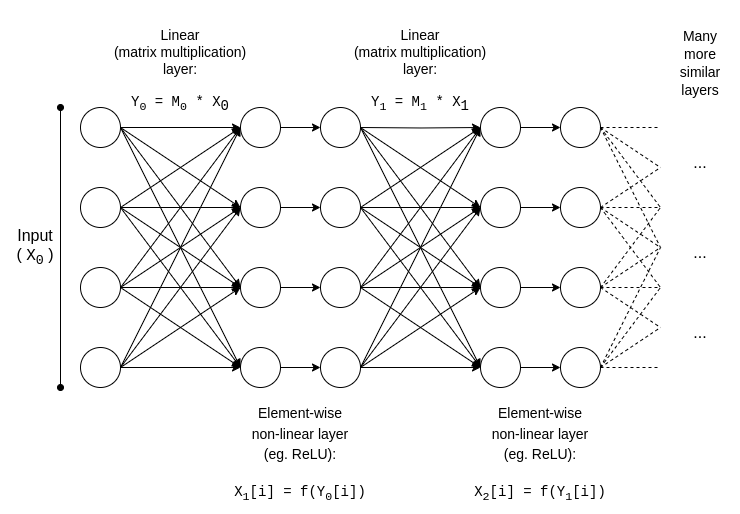

هرچند خوشبختانه، هوش مصنوعی یک است نوع بسیار خاص محاسبات، که آن را برای انواع بهینه سازی ها قابل قبول می کند که انواع محاسبات "بدون ساختار" بیشتر مانند ZK-EVM نمی توانند از آن سود ببرند. اجازه دهید ساختار اصلی یک مدل هوش مصنوعی را بررسی کنیم:

y = max(x, 0)). به طور مجانبی، ضربهای ماتریسی بیشتر کار را به خود اختصاص میدهند: ضرب دو N*N ماتریس ها (2.8) زمان می برد، در حالی که تعداد عملیات غیر خطی بسیار کمتر است. این واقعاً برای رمزنگاری راحت است، زیرا بسیاری از اشکال رمزنگاری میتوانند عملیات خطی را انجام دهند (که ضربهای ماتریسی حداقل اگر مدل را رمزگذاری کنید اما ورودیهای آن را رمزگذاری نکنید) تقریباً «رایگان» هستند..

اگر رمزنگار هستید، احتمالاً قبلاً در مورد پدیده مشابهی شنیده اید رمزنگاری هامومورفیک: اجرا اضافات در متون رمزگذاری شده واقعا آسان است، اما ضرب فوق العاده سخت هستند و ما تا سال 2009 هیچ راهی برای انجام آن با عمق نامحدود پیدا نکردیم.

برای ZK-SNARK ها، معادل آن است پروتکل هایی مانند این از سال 2013، که الف را نشان می دهد کمتر از 4 برابر سربار برای اثبات ضرب های ماتریس. متأسفانه، سربار روی لایههای غیر خطی همچنان قابل توجه است و بهترین اجراها در عمل سربار را حدود 200 برابر نشان میدهند. اما این امید وجود دارد که با تحقیقات بیشتر بتوان این میزان را تا حد زیادی کاهش داد. دیدن این ارائه از رایان کائو برای یک رویکرد اخیر بر اساس GKR، و من توضیح ساده در مورد نحوه عملکرد مؤلفه اصلی GKR.

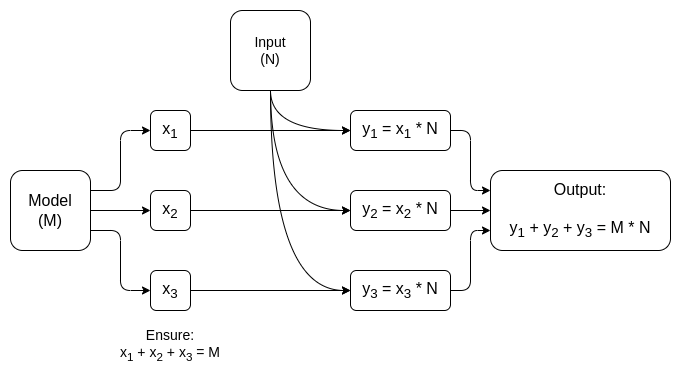

اما برای بسیاری از برنامه ها، ما فقط نمی خواهیم ثابت که یک خروجی AI به درستی محاسبه شده است، ما نیز می خواهیم مدل را مخفی کنید. رویکردهای سادهای برای این کار وجود دارد: میتوانید مدل را به گونهای تقسیم کنید که مجموعهای از سرورها بهطور اضافی هر لایه را ذخیره کنند، و امیدوار باشید که برخی از سرورهایی که برخی از لایهها را نشت میکنند، دادههای زیادی را نشت نکنند. اما اشکال شگفت آور موثری نیز وجود دارد محاسبات تخصصی چند جانبه.

در هر دو مورد، اخلاقیات داستان یکسان است: بزرگترین بخش محاسبات هوش مصنوعی ضربهای ماتریسی است که میتوان برای آنها ایجاد کرد بسیار کارآمد ZK-SNARKها یا MPCها (یا حتی FHE) و بنابراین کل سربار قرار دادن هوش مصنوعی در جعبه های رمزنگاری به طرز شگفت آوری کم است.. به طور کلی، این لایههای غیرخطی هستند که با وجود اندازه کوچکتر، بزرگترین تنگنا هستند. شاید تکنیک های جدیدتری مانند آرگومان های جستجو می تواند کمک کند.

یادگیری ماشینی خصمانه جعبه سیاه

حال، اجازه دهید به مشکل بزرگ دیگر برسیم: انواع حملاتی که می توانید انجام دهید حتی اگر محتویات مدل خصوصی نگه داشته می شود و شما فقط «دسترسی API» به مدل دارید. نقل قول الف مقاله از 2016:

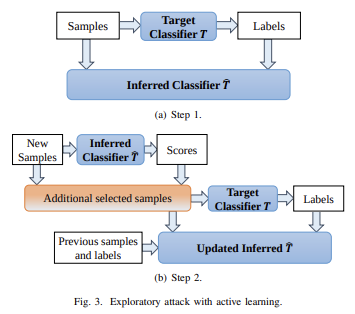

بسیاری از مدلهای یادگیری ماشین در برابر نمونههای متخاصم آسیبپذیر هستند: ورودیهایی که بهطور ویژه ساخته شدهاند تا باعث شوند یک مدل یادگیری ماشین خروجی نادرستی تولید کند. نمونههای متخاصم که بر یک مدل تأثیر میگذارند، اغلب بر مدل دیگر تأثیر میگذارند، حتی اگر دو مدل معماری متفاوتی داشته باشند یا در مجموعههای آموزشی متفاوتی آموزش داده شده باشند، تا زمانی که هر دو مدل برای انجام یک کار آموزش دیده باشند.. بنابراین یک مهاجم ممکن است مدل جایگزین خود را آموزش دهد، نمونه های متخاصم را در برابر جایگزین بسازد، و آنها را با اطلاعات بسیار کمی در مورد قربانی به مدل قربانی منتقل کند.

به طور بالقوه، شما حتی می توانید با دانستن حملات ایجاد کنید فقط داده های آموزشی، حتی اگر به مدلی که می خواهید به آن حمله کنید دسترسی بسیار محدود یا بدون دسترسی دارید. از سال 2023، این نوع حملات همچنان یک مشکل بزرگ هستند.

برای کاهش موثر این نوع حملات جعبه سیاه، باید دو کار را انجام دهیم:

- واقعا محدود کردن چه کسی یا چه چیزی می تواند مدل را جستجو کند و چقدر جعبه های سیاه با دسترسی نامحدود API ایمن نیستند. جعبه های سیاه با دسترسی API بسیار محدود ممکن است.

- پنهان کردن داده های آموزشی، در حالی که حفظ اعتماد به نفس که فرآیند استفاده شده برای ایجاد داده های آموزشی خراب نیست.

پروژه ای که بیشترین کار را در مورد اولی انجام داده است، شاید Worldcoin باشد، که من نسخه قبلی (در میان سایر پروتکل ها) را به طور کامل تجزیه و تحلیل می کنم. اینجا کلیک نمایید. Worldcoin از مدلهای هوش مصنوعی بهطور گسترده در سطح پروتکل استفاده میکند تا (i) اسکنهای عنبیه را به «کدهای عنبیه» کوتاه تبدیل کند که به راحتی قابل مقایسه هستند و (۲) تأیید میکنند که چیزی که اسکن میکند در واقع یک انسان است. دفاع اصلی که Worldcoin بر آن تکیه دارد این واقعیت است که این به کسی اجازه نمیدهد به سادگی مدل هوش مصنوعی را فراخوانی کند: بلکه از سختافزار قابل اعتماد استفاده میکند تا اطمینان حاصل شود که مدل فقط ورودیهایی را میپذیرد که به صورت دیجیتالی توسط دوربین گوی امضا شده است..

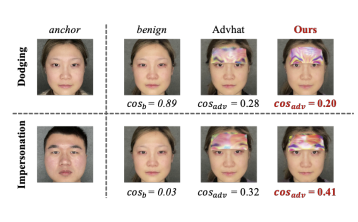

این رویکرد تضمینی برای کارکرد ندارد: به نظر می رسد که می توانید حملات خصمانه ای را علیه هوش مصنوعی بیومتریک انجام دهید که به شکل تکه های فیزیکی یا جواهراتی که می توانید روی صورت خود قرار دهید:

اما امید این است که اگر شما تمام دفاع ها را با هم ترکیب کنیدبا پنهان کردن خود مدل هوش مصنوعی، محدود کردن بسیار زیاد تعداد پرسوجوها، و نیاز به احراز هویت هر کوئری، میتوانید حملات خصمانه را به اندازهای دشوار که سیستم میتواند امن باشد.

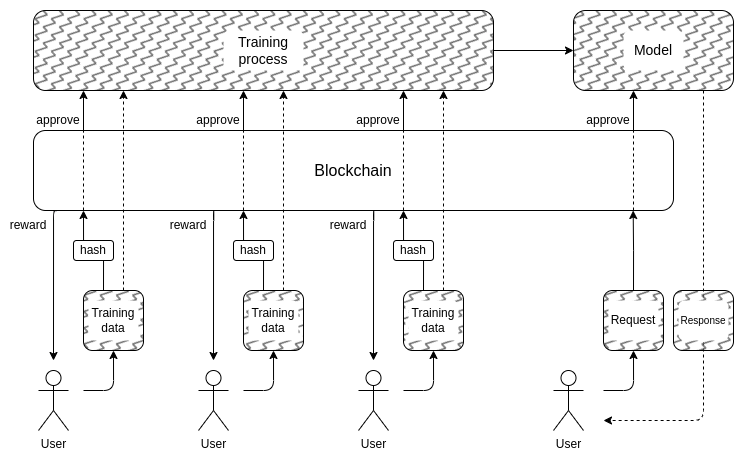

و این ما را به بخش دوم می رساند: چگونه می توانیم داده های آموزشی را پنهان کنیم؟ اینجاست که «DAOها برای اداره دموکراتیک هوش مصنوعی» ممکن است واقعاً منطقی باشد: میتوانیم یک DAO زنجیرهای ایجاد کنیم که بر فرآیند افرادی که مجاز به ارسال دادههای آموزشی هستند (و چه گواهیهایی برای خود دادهها لازم است)، چه کسی مجاز به انجام پرسوجوها و چه تعداد است، نظارت میکند و از تکنیکهای رمزنگاری مانند MPC استفاده میکند. برای رمزگذاری کل خط لوله ایجاد و اجرای هوش مصنوعی از ورودی آموزشی هر کاربر تا خروجی نهایی هر پرس و جو. این DAO می تواند به طور همزمان هدف بسیار محبوب پرداخت غرامت به افراد برای ارسال داده ها را برآورده کند.

- سربار رمزنگاری همچنان ممکن است خیلی زیاد باشد برای اینکه این نوع معماری کاملاً جعبه سیاه با رویکردهای سنتی بسته «به من اعتماد کن» رقابتی باشد.

- ممکن است معلوم شود که راه خوبی برای غیرمتمرکز کردن فرآیند ارسال داده های آموزشی وجود ندارد و محفوظ در برابر حملات مسمومیت

- ابزارهای محاسباتی چند طرفه ممکن است خراب شوند تضمین ایمنی یا حریم خصوصی آنها به دلیل شرکت کنندگان در حال تبانی: به هر حال، این اتفاق در مورد پل های رمزنگاری زنجیره ای متقابل رخ داده است از نو و از نو.

یکی از دلایلی که چرا این بخش را با برچسبهای هشدار دهنده قرمز بزرگتر شروع نکردم که میگویند «قضات هوش مصنوعی نکنید، این دیستوپیانه است» این است که جامعه ما از قبل به شدت به قضات متمرکز غیرقابل پاسخگویی هوش مصنوعی وابسته است: الگوریتمهایی که تعیین میکنند کدام نوع پست ها و نظرات سیاسی در رسانه های اجتماعی تقویت و تقویت می شوند یا حتی سانسور می شوند. من فکر می کنم که گسترش این روند بیشتر در این مرحله ایده بسیار بدی است، اما فکر نمیکنم احتمال زیادی وجود داشته باشد جامعه بلاک چین بیشتر با هوش مصنوعی آزمایش می کند چیزی است که به بدتر شدن آن کمک می کند.

در واقع، راههای بسیار کمریسکی وجود دارد که فناوری کریپتو میتواند حتی این سیستمهای متمرکز موجود را بهتر کند که من به آن اطمینان دارم. یک تکنیک ساده این است. AI تأیید شده با انتشار تأخیر: هنگامی که یک سایت رسانه اجتماعی یک رتبه بندی پست های مبتنی بر هوش مصنوعی انجام می دهد، می تواند یک ZK-SNARK منتشر کند که هش مدلی را که این رتبه بندی را ایجاد کرده است را ثابت کند. این سایت میتواند متعهد شود که مدلهای هوش مصنوعی خود را بعد از مثال فاش کند. یک سال تاخیر هنگامی که یک مدل فاش شد، کاربران میتوانند هش را بررسی کنند تا تأیید کنند که مدل صحیح منتشر شده است، و انجمن میتواند آزمایشهایی را روی مدل برای تأیید عادلانه بودن آن انجام دهد. تأخیر انتشار تضمین می کند که تا زمانی که مدل فاش می شود، از قبل قدیمی شده است.

بنابراین در مقایسه با متمرکز جهان، سوال این نیست if ما می توانیم بهتر عمل کنیم، اما توسط چه مقدار. برای جهان غیر متمرکزبا این حال، مهم است که مراقب باشید: اگر کسی بسازد به عنوان مثال. یک بازار پیش بینی یا یک استیبل کوین که از یک اوراکل هوش مصنوعی استفاده می کند، و معلوم می شود که اوراکل قابل حمله است، این مقدار زیادی پول است که می تواند در یک لحظه ناپدید شود..

هوش مصنوعی به عنوان هدف بازی

اگر تکنیکهای بالا برای ایجاد یک هوش مصنوعی غیرمتمرکز مقیاسپذیر، که محتویات آن یک جعبه سیاه است که هیچکس آن را نمیشناسد، واقعاً بتواند کار کند، در این صورت میتوان از آن برای ایجاد هوش مصنوعی با ابزاری فراتر از بلاک چین استفاده کرد. تیم پروتکل NEAR در حال ساخت این یک است هدف اصلی کار مداوم آنها.

دو دلیل برای این کار وجود دارد:

- اگر شما می توان ساختن "هوش مصنوعی جعبه سیاه قابل اعتمادبا اجرای فرآیند آموزش و استنتاج با استفاده از ترکیبی از بلاک چین و MPC، بسیاری از برنامههای کاربردی که در آن کاربران نگران سوگیری یا تقلب سیستم هستند، میتوانند از آن بهره ببرند. بسیاری از مردم ابراز تمایل کرده اند حکومت دموکراتیک از AI های سیستمی مهم که ما به آن وابسته خواهیم بود؛ تکنیک های رمزنگاری و مبتنی بر بلاک چین می تواند راهی برای انجام این کار باشد.

- از یک ایمنی هوش مصنوعی از منظر، این تکنیکی است برای ایجاد یک هوش مصنوعی غیرمتمرکز که همچنین دارای یک سوئیچ کشتن طبیعی است و می تواند پرس و جوهایی را که به دنبال استفاده از هوش مصنوعی برای رفتارهای مخرب هستند محدود کند.

همچنین شایان ذکر است که «استفاده از مشوقهای رمزنگاری برای ایجاد انگیزه برای ساخت هوش مصنوعی بهتر» بدون استفاده از رمزنگاری برای رمزگذاری کامل آن میتواند انجام شود: رویکردهایی مانند BitTensor در این گروه قرار می گیرند.

نتیجه گیری

اکنون که هر دو بلاک چین و هوش مصنوعی در حال قدرتمندتر شدن هستند، تعداد موارد استفاده در تقاطع این دو منطقه رو به افزایش است. با این حال، برخی از این موارد استفاده بسیار منطقی تر و بسیار قوی تر از بقیه هستند. به طور کلی، از مواردی استفاده کنید که مکانیسم زیربنایی همچنان تقریباً مانند قبل طراحی می شود، اما فرد بازیکنان تبدیل شدن به هوش مصنوعی، که به مکانیزم اجازه می دهد تا به طور موثر در مقیاس بسیار کوچکتر عمل کند، بلافاصله امیدوارکننده ترین و آسان ترین راه حل هستند.

چالش برانگیزترین راه برای درست کردن برنامههایی هستند که سعی میکنند از زنجیرههای بلوکی و تکنیکهای رمزنگاری برای ایجاد یک «تکتن» استفاده کنند: یک هوش مصنوعی غیرمتمرکز مورد اعتماد که برخی از برنامهها برای اهدافی به آن تکیه میکنند. این برنامهها هم از نظر عملکرد و هم برای بهبود ایمنی هوش مصنوعی به گونهای که از خطرات متمرکز مرتبط با رویکردهای اصلیتر برای آن مشکل جلوگیری میکند، نویدبخش است. اما راه های بسیاری نیز وجود دارد که در آن مفروضات اساسی ممکن است شکست بخورند. از این رو، ارزش آن را دارد که با دقت قدم بردارید، به خصوص هنگام استقرار این برنامه ها در زمینه های با ارزش و پرخطر.

من مشتاقانه منتظر تلاش های بیشتری برای موارد استفاده سازنده از هوش مصنوعی در همه این زمینه ها هستم، بنابراین ما می توانیم ببینیم کدام یک از آنها واقعاً در مقیاس قابل اجرا هستند.

نویسنده: ویتالیک بوترین

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- BlockOffsets. نوسازی مالکیت افست زیست محیطی. دسترسی به اینجا.

- منبع: هوش داده افلاطون