تشخیص خودکار نقص با استفاده از بینایی کامپیوتر به بهبود کیفیت و کاهش هزینه بازرسی کمک می کند. تشخیص عیب شامل شناسایی وجود یک نقص، طبقه بندی انواع عیوب و شناسایی محل قرارگیری عیوب است. بسیاری از فرآیندهای تولید نیاز به تشخیص با تاخیر کم، با منابع محاسباتی محدود، و با اتصال محدود دارند.

Amazon Lookout for Vision یک سرویس یادگیری ماشینی (ML) است که به شناسایی عیوب محصول با استفاده از بینایی رایانه کمک می کند تا فرآیند بازرسی کیفیت در خطوط تولید شما را خودکار کند، بدون نیاز به تخصص ML. Lookout for Vision اکنون شامل توانایی ارائه مکان و نوع ناهنجاری ها با استفاده از مدل های تقسیم بندی معنایی ML است. این مدل های ML سفارشی شده را می توان با استفاده از AWS Cloud مستقر کرد API های ابری یا با استفاده از سخت افزار لبه سفارشی AWS IoT Greengrass. Lookout for Vision اکنون از استنتاج بر روی یک پلتفرم محاسباتی x86 که لینوکس را با یا بدون شتابدهنده GPU NVIDIA و در هر دستگاه لبه مبتنی بر NVIDIA Jetson اجرا میکند، پشتیبانی میکند. این انعطاف پذیری امکان تشخیص نقص در سخت افزار موجود یا جدید را فراهم می کند.

در این پست، ما به شما نشان می دهیم که چگونه قطعات معیوب را با استفاده از مدل های Lookout for Vision ML که بر روی یک دستگاه لبه اجرا می شوند، شناسایی کنید، که با استفاده از یک دستگاه شبیه سازی ابر محاسبه الاستیک آمازون نمونه (Amazon EC2). ما در آموزش مدلهای تقسیمبندی معنایی جدید، صادرات آنها بهعنوان مؤلفههای AWS IoT Greengrass و اجرای استنتاج در حالت فقط CPU با کد مثال پایتون قدم میزنیم.

بررسی اجمالی راه حل

در این پست از مجموعه ای از تصاویر استفاده می کنیم بیگانگان اسباب بازی متشکل از تصاویر عادی و معیوب مانند اندام های از دست رفته، چشم ها یا سایر قسمت ها. ما یک مدل Lookout for Vision را در ابر آموزش می دهیم تا بیگانگان اسباب بازی معیوب را شناسایی کند. ما مدل را در یک CPU هدف X86 کامپایل میکنیم، مدل Lookout for Vision را بهعنوان یک مؤلفه AWS IoT Greengrass بستهبندی میکنیم، و مدل را با استفاده از کنسول AWS IoT Greengrass در یک نمونه EC2 بدون GPU مستقر میکنیم. در نهایت، ما یک برنامه نمونه مبتنی بر پایتون را نشان میدهیم که بر روی نمونه EC2 (C5a.2xl) اجرا میشود که تصاویر بیگانه اسباببازی را از سیستم فایل دستگاه لبه منبع میکند، استنتاج را بر روی مدل Lookout for Vision با استفاده از gRPC رابط، و داده های استنتاج را به یک می فرستد MQTT موضوع در AWS Cloud. اسکریپت ها تصویری را تولید می کنند که شامل رنگ و محل ایرادات روی تصویر غیرعادی است.

نمودار زیر معماری راه حل را نشان می دهد. توجه به این نکته مهم است که برای هر نوع نقصی که می خواهید در محلی سازی شناسایی کنید، باید 10 تصویر ناهنجاری علامت گذاری شده در آموزش و 10 تصویر در داده های آزمایشی داشته باشید، در مجموع 20 تصویر از آن نوع. برای این پست، اندام های گم شده روی اسباب بازی را جستجو می کنیم.

راه حل دارای گردش کار زیر است:

- یک مجموعه داده آموزشی و یک مجموعه داده آزمایشی را بارگذاری کنید سرویس ذخیره سازی ساده آمازون (Amazon S3).

- از رابط کاربری جدید Lookout for Vision برای اضافه کردن نوع ناهنجاری و علامت گذاری محل آن ناهنجاری ها در تصاویر آموزشی و آزمایشی استفاده کنید.

- یک مدل Lookout for Vision را در فضای ابری آموزش دهید.

- مدل را در معماری هدف (X86) کامپایل کنید و مدل را با استفاده از کنسول AWS IoT Greengrass در نمونه EC2 (C5a.2xl) مستقر کنید.

- منبع تصاویر از دیسک محلی.

- استنتاج ها را روی مدل مستقر شده از طریق رابط gRPC اجرا کنید و تصویری از ماسک های ناهنجاری را که روی تصویر اصلی پوشانده شده است، بازیابی کنید.

- نتایج استنتاج را به یک کلاینت MQTT که روی نمونه لبه اجرا می شود، ارسال کنید.

- دریافت پیام MQTT در مورد یک موضوع در AWS IoT Core در AWS Cloud برای نظارت و تجسم بیشتر.

مراحل 5، 6 و 7 با نمونه برنامه پایتون هماهنگ شده است.

پیش نیازها

قبل از شروع، پیش نیازهای زیر را تکمیل کنید. برای این پست، ما از یک نمونه EC2 c5.2xl استفاده می کنیم و AWS IoT Greengrass V2 را روی آن نصب می کنیم تا ویژگی های جدید را امتحان کنیم. اگر می خواهید روی NVIDIA Jetson اجرا کنید، مراحل پست قبلی ما را دنبال کنید. Amazon Lookout for Vision اکنون از بازرسی بصری نقص های محصول در لبه پشتیبانی می کند.

- یک حساب AWS ایجاد کنید.

- یک نمونه EC2 را شروع کنید که بتوانیم AWS IoT Greengrass را روی آن نصب کنیم و از حالت جدید استنتاج فقط CPU استفاده کنیم. همچنین می توانید از یک دستگاه Intel X86 64 بیتی با 8 گیگابایت رم یا بیشتر استفاده کنید (ما از c5a.2xl استفاده می کنیم، اما از هر چیزی که بیش از 8 گیگابایت در پلتفرم x86 باید کار کند) که اوبونتو 20.04 را اجرا می کند.

- AWS IoT Greengrass V2 را نصب کنید:

- سیستم مورد نیاز و وابستگی های پایتون 3 (اوبونتو 20.04) را نصب کنید:

مجموعه داده را آپلود کنید و مدل را آموزش دهید

ما با استفاده از مجموعه داده بیگانگان اسباب بازی برای نشان دادن راه حل مجموعه داده شامل تصاویر عادی و غیرعادی است. در اینجا چند تصویر نمونه از مجموعه داده آورده شده است.

تصویر زیر یک بیگانه اسباب بازی معمولی را نشان می دهد.

تصویر زیر یک بیگانه اسباب بازی را نشان می دهد که پای خود را از دست داده است.

تصویر زیر یک بیگانه اسباب بازی را نشان می دهد که سرش را از دست داده است.

در این پست به دنبال اندام های از دست رفته می گردیم. ما از رابط کاربری جدید برای ترسیم ماسکی در اطراف عیوب در داده های آموزش و آزمایش خود استفاده می کنیم. این به مدل های تقسیم بندی معنایی می گوید که چگونه این نوع نقص را شناسایی کنند.

- با آپلود مجموعه داده خود از طریق آمازون S3 یا از رایانه خود شروع کنید.

- آنها را در پوشه هایی با عنوان مرتب کنید

normalوanomaly. - هنگام ایجاد مجموعه داده خود، انتخاب کنید برچسبها را به صورت خودکار به تصاویر بر اساس نام پوشه متصل کنیداین به ما امکان میدهد بعداً تصاویر غیرعادی را مرتب کنیم و قسمتهایی را که قرار است با یک نقص برچسب گذاری میشوند ترسیم کنیم.

- سعی کنید برخی از تصاویر را برای آزمایش بعد از هر دو نگه دارید

normalوanomaly. - بعد از اینکه همه تصاویر به مجموعه داده اضافه شدند، را انتخاب کنید برچسب های ناهنجاری را اضافه کنید.

- برچسب گذاری داده ها را با انتخاب شروع کنید شروع به برچسب زدن کنید.

- برای سرعت بخشیدن به فرآیند، می توانید چندین تصویر را انتخاب کرده و آنها را به عنوان طبقه بندی کنید

NormalorAnomaly.

اگر میخواهید علاوه بر طبقهبندی ناهنجاریها را برجسته کنید، باید محل قرارگیری ناهنجاریها را مشخص کنید. - تصویری را که می خواهید حاشیه نویسی کنید انتخاب کنید.

- از ابزارهای طراحی برای نشان دادن ناحیه ای که بخشی از سوژه گم شده است استفاده کنید یا یک ماسک روی نقص بکشید.

- را انتخاب کنید ارسال کنید و ببندید برای حفظ این تغییرات

- این روند را برای همه تصاویر خود تکرار کنید.

- وقتی کارتان تمام شد، انتخاب کنید ذخیره برای تداوم تغییرات شما اکنون شما آماده آموزش مدل خود هستید.

- را انتخاب کنید مدل قطار.

پس از انجام این مراحل، می توانید به پروژه و مسیر بروید مدل صفحه برای بررسی عملکرد مدل آموزش دیده. شما می توانید فرآیند صادرات مدل به دستگاه لبه هدف را در هر زمانی پس از آموزش مدل شروع کنید.

آموزش مجدد مدل با تصاویر تصحیح شده

گاهی اوقات ممکن است برچسب گذاری ناهنجاری کاملاً صحیح نباشد. شما این شانس را دارید که به مدل خود کمک کنید تا ناهنجاری های شما را بهتر یاد بگیرد. به عنوان مثال، تصویر زیر به عنوان یک ناهنجاری شناسایی شده است، اما آن را نشان نمی دهد missing_limbs برچسب.

بیایید ویرایشگر را باز کنیم و این مشکل را برطرف کنیم.

هر تصویری که به این شکل پیدا کردید را مرور کنید. اگر متوجه شدید که یک ناهنجاری به اشتباه برچسب گذاری شده است، می توانید از ابزار پاک کن برای حذف برچسب نادرست استفاده کنید.

اکنون می توانید دوباره مدل خود را آموزش دهید و به دقت بهتری دست یابید.

مدل را به عنوان یک جزء AWS IoT Greengrass کامپایل و بسته بندی کنید

در این بخش، مراحل را طی میکنیم تا مدل بیگانه اسباببازی را در دستگاه لبه هدف خود کامپایل کنیم و مدل را به عنوان یک جزء AWS IoT Greengrass بسته بندی کنیم.

- در کنسول Lookout for Vision، پروژه خود را انتخاب کنید.

- در صفحه پیمایش، را انتخاب کنید بسته های مدل لبه.

- را انتخاب کنید کار بسته بندی مدل ایجاد کنید.

- برای اسم شغل، یک نام وارد کنید.

- برای شرح شغل، یک توضیح اختیاری وارد کنید.

- را انتخاب کنید مدل ها را مرور کنید.

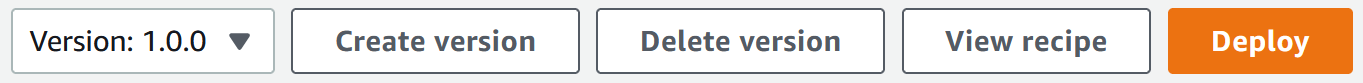

- نسخه مدل را انتخاب کنید (مدل اسباب بازی بیگانه ساخته شده در بخش قبل).

- را انتخاب کنید را انتخاب کنید.

- اگر این را در Amazon EC2 یا دستگاه X86-64 اجرا می کنید، انتخاب کنید پلت فرم هدف و انتخاب کنید لینـوکــس, X86و پردازنده.

اگر از CPU استفاده می کنید، اگر مطمئن نیستید و GPU NVIDIA ندارید، می توانید گزینه های کامپایلر را خالی بگذارید. اگر پلتفرم مبتنی بر اینتل دارید که از AVX512 پشتیبانی می کند، می توانید این گزینه های کامپایلر را برای بهینه سازی برای عملکرد بهتر اضافه کنید:{"mcpu": "skylake-avx512"}. میتوانید نام و وضعیت شغلی خود را ببینید که به صورت نشان داده میشود

میتوانید نام و وضعیت شغلی خود را ببینید که به صورت نشان داده میشود In progress. کار بسته بندی مدل ممکن است چند دقیقه طول بکشد. وقتی کار بسته بندی مدل کامل شد، وضعیت به صورتSuccess. - نام شغل خود را انتخاب کنید (در مورد ما این است

aliensblogcpux86) برای دیدن جزئیات کار.

- را انتخاب کنید کار بسته بندی مدل ایجاد کنید.

- مشخصات را برای نام قطعه, شرح کامپوننت (اختیاری)، نسخه کامپوننتو مکان کامپوننت.Lookout for Vision دستور العمل ها و مصنوعات جزء را در این مکان Amazon S3 ذخیره می کند.

- را انتخاب کنید به استقرار در گرین گراس ادامه دهید برای استقرار کامپوننت در دستگاه لبه هدف.

اجزای AWS IoT Greengrass و مصنوعات مدل در حساب AWS شما ایجاد شده است.

مدل را مستقر کنید

قبل از ادامه، مطمئن شوید که AWS IoT Greengrass V2 را روی دستگاه مورد نظر خود برای حساب خود نصب کرده اید. برای دستورالعمل، مراجعه کنید نرم افزار AWS IoT Greengrass Core را نصب کنید.

در این بخش، مراحل استقرار مدل بیگانه اسباببازی را در دستگاه لبه با استفاده از کنسول AWS IoT Greengrass طی میکنیم.

- در کنسول AWS IoT Greengrass، به دستگاه لبه خود بروید.

- را انتخاب کنید گسترش برای شروع مراحل استقرار

- انتخاب کنید دستگاه هسته (زیرا استقرار در یک دستگاه واحد است) و نامی برای آن وارد کنید نام هدف.نام هدف همان نامی است که برای نامگذاری دستگاه اصلی در طول فرآیند نصب AWS IoT Greengrass V2 استفاده کردید.

- جزء خود را انتخاب کنید در مورد ما، نام کامپوننت است

aliensblogcpux86که حاوی مدل بیگانه اسباب بازی است. - را انتخاب کنید بعدی.

- کامپوننت را پیکربندی کنید (اختیاری).

- را انتخاب کنید بعدی.

- گسترش سیاست های استقرار.

- برای خط مشی به روز رسانی مؤلفه، انتخاب کنید به اجزاء اطلاع دهید.این به مؤلفه قبلاً مستقر شده (نسخه قبلی مؤلفه) اجازه می دهد تا به روز رسانی را تا زمانی که آماده به روز رسانی باشید به تعویق بیاندازد.

- برای سیاست رسیدگی به شکست، انتخاب کنید عقب نگرددر صورت خرابی، این گزینه به ما اجازه می دهد تا خطاهای موجود در استقرار را بررسی کنیم.

- را انتخاب کنید بعدی.

- فهرست اجزایی که در دستگاه هدف (لبه) مستقر خواهند شد را مرور کنید.

- را انتخاب کنید بعدیشما باید پیام را ببینید

Deployment successfully created. - برای تأیید اعتبار موفقیت آمیز استقرار مدل، دستور زیر را در دستگاه لبه خود اجرا کنید:

شما باید خروجی مشابهی را ببینید که در حال اجرا است aliensblogcpux86 اسکریپت راه اندازی چرخه حیات:

کامپوننت هایی که در حال حاضر در Greengrass اجرا می شوند:

استنتاج ها را روی مدل اجرا کنید

توجه داشته باشید: اگر Greengrass را به عنوان کاربر دیگری غیر از آنچه وارد شده اید اجرا می کنید، باید مجوزهای فایل را تغییر دهید. /tmp/aws.iot.lookoutvision.EdgeAgent.sock:

ما اکنون آماده اجرای استنباط بر روی مدل هستیم. در دستگاه لبه خود، دستور زیر را برای بارگذاری مدل اجرا کنید (جایگزین کنید با نام مدل استفاده شده در کامپوننت شما):

برای تولید استنتاج، دستور زیر را با نام فایل منبع اجرا کنید (جایگزین کنید با مسیر و نام فایل تصویر برای بررسی و جایگزینی با نام مدل استفاده شده برای جزء شما):

مدل به درستی تصویر را غیرعادی پیش بینی می کند (missing_limbs) با امتیاز اطمینان 0.9996867775917053. ماسک تگ ناهنجاری را به ما می گوید missing_limbs و سطح درصد پاسخ همچنین حاوی داده های بیت مپ است که می توانید از آنچه پیدا کرده رمزگشایی کنید.

فایل را دانلود و باز کنید blended.png، که شبیه تصویر زیر است. به ناحیه ای که با نقص در اطراف پاها برجسته شده است توجه کنید.

داستان مشتری

با استفاده از AWS IoT Greengrass و Lookout for Vision، اکنون میتوانید بازرسی بصری را با بینایی رایانه برای فرآیندهایی مانند کنترل کیفیت و ارزیابی نقص بهطور خودکار انجام دهید - همه در لبه و در زمان واقعی. میتوانید مشکلاتی مانند آسیبدیدگی قطعات (مانند فرورفتگی، خراش، یا جوش ضعیف)، اجزای محصول از دست رفته یا نقصها را با تکرار الگوهای خط تولید شناسایی کنید و در وقت و هزینهتان صرفهجویی کنید. مشتریانی مانند تایسون و باکستر در حال کشف قدرت Lookout for Vision برای افزایش کیفیت و کاهش هزینه های عملیاتی با بازرسی بصری خودکار هستند.

«تعالی عملیاتی یک اولویت کلیدی در تایسون فودز است. تعمیر و نگهداری پیشبینیشده دارایی ضروری برای دستیابی به این هدف با بهبود مستمر اثربخشی کلی تجهیزات (OEE) است. در سال 2021، تایسون فودز یک پروژه بینایی کامپیوتری مبتنی بر یادگیری ماشینی را برای شناسایی حامل های محصول ناموفق در طول تولید راه اندازی کرد تا از تأثیرگذاری آنها بر ایمنی اعضای تیم، عملیات یا کیفیت محصول جلوگیری کند. مدل هایی که با استفاده از Amazon Lookout for Vision آموزش دیدند عملکرد خوبی داشتند. مدل تشخیص پین به دقت 95 درصد در هر دو کلاس دست یافت. مدل Amazon Lookout for Vision به گونه ای تنظیم شده است که با دقت 99.1 درصد برای تشخیص خطای پین کار کند. تا حد زیادی هیجان انگیزترین نتیجه این پروژه افزایش سرعت در زمان توسعه بود. اگرچه این پروژه از دو مدل و یک کد برنامه پیچیدهتر استفاده میکند، اما برای تکمیل آن ۱۲ درصد زمان کمتری از توسعهدهندگان صرف شده است. این پروژه برای نظارت بر وضعیت حامل های محصول در تایسون فودز با استفاده از خدمات مدیریت شده AWS مانند Amazon Lookout for Vision در زمان بی سابقه تکمیل شد.

- آدری تیمرمن، پدر توسعهدهنده برنامههای کاربردی، تایسون فودز.

تأخیر و سرعت استنباط برای ارزیابی بلادرنگ و بررسی کیفیت حیاتی فرآیندهای تولید ما حیاتی است. Amazon Lookout for Vision edge در یک دستگاه CPU به ما این توانایی را می دهد که در تجهیزات درجه تولید به این هدف دست پیدا کنیم و ما را قادر می سازد راه حل های مقرون به صرفه بینایی هوش مصنوعی را در مقیاس ارائه دهیم.

— AK Karan، مدیر ارشد جهانی – تحول دیجیتال، زنجیره تامین یکپارچه، شرکت بینالمللی باکستر.

پاک کردن

مراحل زیر را برای حذف داراییهایی که ایجاد کردهاید از حساب خود انجام دهید و از صورتحسابهای مداوم جلوگیری کنید:

- در کنسول Lookout for Vision، به پروژه خود بروید.

- بر اعمال منو، مجموعه داده های خود را حذف کنید.

- مدل های خود را حذف کنید

- در کنسول آمازون S3، سطل هایی را که ایجاد کرده اید خالی کنید، سپس سطل ها را حذف کنید.

- در کنسول آمازون EC2، نمونهای را که شروع به اجرای AWS IoT Greengrass کردهاید، حذف کنید.

- در کنسول AWS IoT Greengrass، را انتخاب کنید استقرار در صفحه ناوبری

- نسخه های کامپوننت خود را حذف کنید.

- در کنسول AWS IoT Greengrass، چیزها، گروه ها و دستگاه های AWS IoT را حذف کنید.

نتیجه

در این پست، ما یک سناریوی معمولی برای تشخیص عیب صنعتی در لبه با استفاده از محلی سازی نقص و مستقر در یک دستگاه فقط CPU توضیح دادیم. ما با استفاده از Lookout for Vision و AWS IoT Greengrass، اجزای کلیدی چرخه حیات ابر و لبه را با یک مثال سرتاسری بررسی کردیم. با Lookout for Vision، ما یک مدل تشخیص ناهنجاری در ابر را با استفاده از آموزش آموزش دادیم مجموعه داده بیگانه اسباب بازی، مدل را در یک معماری هدف کامپایل کرد و مدل را به عنوان یک جزء AWS IoT Greengrass بسته بندی کرد. با AWS IoT Greengrass، مدل را در یک دستگاه لبه مستقر کردیم. ما یک برنامه نمونه مبتنی بر پایتون را نشان دادیم که تصاویر بیگانه اسباببازی را از سیستم فایل محلی دستگاه لبه منبع میگیرد، استنتاجها را بر روی مدل Lookout for Vision در لبه با استفاده از رابط gRPC اجرا میکند، و دادههای استنتاج را به یک موضوع MQTT در AWS ارسال میکند. ابر

در یک پست آینده، نحوه اجرای استنتاج بر روی یک جریان واقعی تصاویر با استفاده از خط لوله رسانه GStreamer را نشان خواهیم داد.

سفر خود را به سمت تشخیص و شناسایی ناهنجاری های صنعتی با مراجعه به سایت آغاز کنید Amazon Lookout for Vision و AWS IoT Greengrass صفحات منبع

درباره نویسندگان

مانیش تالرجا یک مدیر ارشد تمرین ML صنعتی با خدمات حرفه ای AWS است. او به مشتریان AWS کمک می کند تا با معماری و ساخت راه حل های نوآورانه ای که از خدمات AWS ML و IoT در AWS Cloud استفاده می کنند، به اهداف تجاری خود برسند.

مانیش تالرجا یک مدیر ارشد تمرین ML صنعتی با خدمات حرفه ای AWS است. او به مشتریان AWS کمک می کند تا با معماری و ساخت راه حل های نوآورانه ای که از خدمات AWS ML و IoT در AWS Cloud استفاده می کنند، به اهداف تجاری خود برسند.

رایان وندرورف یک معمار راه حل های شریک در خدمات وب آمازون است. او قبلاً به عنوان مهندس نرم افزار در OCI در تیم Grails و Micronaut، مشاوره و توسعه پروژه متمرکز بر ماشین مجازی جاوا را ارائه می کرد. او معمار/مدیر اصلی محصولات در ReachForce بود، با تمرکز بر نرم افزار و معماری سیستم برای راه حل های AWS Cloud SaaS برای مدیریت داده های بازاریابی. رایان از سال 1996 چندین راه حل SaaS در چندین حوزه مانند شرکت های مالی، رسانه، مخابرات و آموزش الکترونیکی ساخته است.

رایان وندرورف یک معمار راه حل های شریک در خدمات وب آمازون است. او قبلاً به عنوان مهندس نرم افزار در OCI در تیم Grails و Micronaut، مشاوره و توسعه پروژه متمرکز بر ماشین مجازی جاوا را ارائه می کرد. او معمار/مدیر اصلی محصولات در ReachForce بود، با تمرکز بر نرم افزار و معماری سیستم برای راه حل های AWS Cloud SaaS برای مدیریت داده های بازاریابی. رایان از سال 1996 چندین راه حل SaaS در چندین حوزه مانند شرکت های مالی، رسانه، مخابرات و آموزش الکترونیکی ساخته است.

پراکاش کریشنان مدیر ارشد توسعه نرم افزار در خدمات وب آمازون است. او تیمهای مهندسی را رهبری میکند که در حال ساختن سیستمهای توزیعشده در مقیاس بزرگ هستند تا الگوریتمهای سریع، کارآمد و بسیار مقیاسپذیر را برای مشکلات تشخیص تصویر و ویدیو مبتنی بر یادگیری عمیق اعمال کنند.

پراکاش کریشنان مدیر ارشد توسعه نرم افزار در خدمات وب آمازون است. او تیمهای مهندسی را رهبری میکند که در حال ساختن سیستمهای توزیعشده در مقیاس بزرگ هستند تا الگوریتمهای سریع، کارآمد و بسیار مقیاسپذیر را برای مشکلات تشخیص تصویر و ویدیو مبتنی بر یادگیری عمیق اعمال کنند.