این یک پست مهمان است که با همکاری اسکات گوترمن از تور PGA نوشته شده است.

هوش مصنوعی مولد (هوش مصنوعی مولد) امکانات جدیدی را برای ساختن سیستمهای هوشمند فراهم کرده است. پیشرفتهای اخیر در مدلهای زبان بزرگ مبتنی بر هوش مصنوعی (LLM) استفاده از آنها را در برنامههای مختلف پیرامون بازیابی اطلاعات امکانپذیر کرده است. با توجه به منابع داده، LLMها ابزارهایی را ارائه کردند که به ما امکان میدهد یک ربات گفتگوی پرسش و پاسخ در چند هفته بسازیم، نه آنچه ممکن است سالها قبل و احتمالاً با عملکرد بدتر باشد. ما یک راه حل Retrieval-Augmented-Generation (RAG) را فرموله کردیم که به تور PGA اجازه می دهد یک نمونه اولیه برای پلتفرم تعامل طرفداران آینده ایجاد کند که می تواند داده های خود را به روشی تعاملی در قالب مکالمه در دسترس طرفداران قرار دهد.

استفاده از دادههای ساختاریافته برای پاسخ به سؤالات نیازمند روشی برای استخراج مؤثر دادههایی است که به درخواست کاربر مرتبط است. ما یک رویکرد متن به SQL را فرموله کردیم که در آن درخواست زبان طبیعی کاربر با استفاده از یک LLM به یک عبارت SQL تبدیل میشود. SQL توسط اجرا می شود آمازون آتنا برای برگرداندن داده های مربوطه این داده ها دوباره به یک LLM ارائه می شود، که از آن خواسته می شود با توجه به داده ها به درخواست کاربر پاسخ دهد.

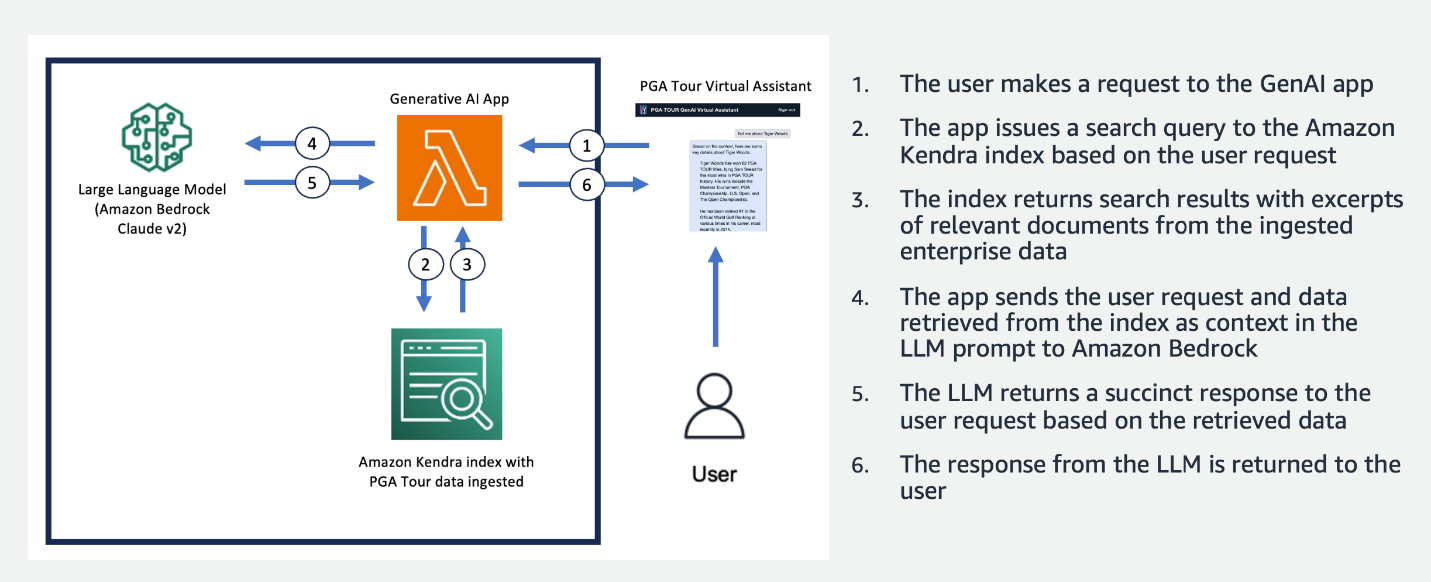

استفاده از داده های متنی نیاز به شاخصی دارد که بتوان از آن برای جستجو و ارائه زمینه مرتبط به یک LLM برای پاسخ به پرسش کاربر استفاده کرد. برای فعال کردن بازیابی سریع اطلاعات، از آمازون کندرا به عنوان شاخص این اسناد. هنگامی که کاربران سؤال می پرسند، دستیار مجازی ما به سرعت در فهرست آمازون کندرا جستجو می کند تا اطلاعات مرتبط را بیابد. آمازون کندرا از پردازش زبان طبیعی (NLP) برای درک پرسشهای کاربر و یافتن مرتبطترین اسناد استفاده میکند. سپس اطلاعات مربوطه برای تولید پاسخ نهایی در اختیار LLM قرار می گیرد. راه حل نهایی ما ترکیبی از این رویکردهای text-to-SQL و text-RAG است.

در این پست ما چگونگی مرکز نوآوری هوش مصنوعی AWS همکاری کرد خدمات حرفه ای AWS و تور PGA برای توسعه نمونه اولیه دستیار مجازی با استفاده از بستر آمازون که می تواند طرفداران را قادر سازد تا اطلاعات مربوط به هر رویداد، بازیکن، حفره یا جزئیات سطح شات را به شیوه ای تعاملی یکپارچه استخراج کنند. Amazon Bedrock یک سرویس کاملاً مدیریت شده است که انتخابی از مدلهای پایه (FM) با کارایی بالا را از شرکتهای پیشرو هوش مصنوعی مانند AI21 Labs، Anthropic، Cohere، Meta، Stability AI و Amazon از طریق یک API منفرد، همراه با مجموعه گستردهای از آن ارائه میکند. قابلیت هایی که برای ساختن برنامه های هوش مصنوعی مولد با امنیت، حریم خصوصی و هوش مصنوعی مسئول نیاز دارید.

توسعه: آماده سازی داده ها

مانند هر پروژه داده محور، عملکرد فقط به خوبی داده ها خواهد بود. ما داده ها را پردازش کردیم تا LLM بتواند به طور مؤثر داده های مربوطه را پرس و جو کند و بازیابی کند.

برای دادههای رقابت جدولی، ما بر روی زیرمجموعهای از دادههای مرتبط با بیشترین تعداد درخواستهای کاربر تمرکز کردیم و ستونها را به طور مستقیم برچسبگذاری کردیم، به طوری که درک آنها برای LLM آسانتر باشد. ما همچنین تعدادی ستون کمکی ایجاد کردیم تا به LLM کمک کنیم مفاهیمی را که در غیر این صورت ممکن است با آنها مشکل داشته باشد را درک کند. به عنوان مثال، اگر یک گلف باز یک تیر کمتر از حد معمول شلیک کند (مثلاً در 3 شوت در نقطه 4 یا در 4 شوت در نقطه 5)، معمولاً به آن ضربه می گویند. مرغدار. اگر کاربر بپرسد "بازیکن X در سال گذشته چند مرغ ساخته است؟"، فقط داشتن امتیاز و تراز در جدول کافی نیست. در نتیجه، ستونهایی را برای نشان دادن اصطلاحات رایج گلف، مانند بوگی، پرنده، و عقاب اضافه کردیم. علاوه بر این، ما دادههای Competition را با یک مجموعه ویدیویی جداگانه با پیوستن به یک ستون برای a مرتبط کردیم video_id، که به برنامه ما امکان می دهد ویدیوی مرتبط با یک عکس خاص را در داده های مسابقه بکشد. ما همچنین اتصال دادههای متنی به دادههای جدولی را فعال کردیم، برای مثال اضافه کردن بیوگرافی برای هر بازیکن به عنوان یک ستون متنی. شکل های زیر روند گام به گام نحوه پردازش یک پرس و جو برای خط لوله متن به SQL را نشان می دهد. اعداد نشان دهنده سری مراحل برای پاسخ به یک پرس و جو هستند.

در شکل زیر خط لوله سرتاسر خود را نشان می دهیم. ما استفاده می کنیم AWS لامبدا به عنوان تابع ارکستراسیون ما مسئول تعامل با منابع داده های مختلف، LLM ها و تصحیح خطا بر اساس درخواست کاربر است. مراحل 1-8 شبیه به آنچه در شکل بعدی نشان داده شده است. تغییرات جزئی برای داده های بدون ساختار وجود دارد که در ادامه به آن می پردازیم.

دادههای متنی به مراحل پردازش منحصربهفردی نیاز دارند که اسناد طولانی را به قسمتهایی که توسط LLM قابل هضم هستند، تکه (یا قطعهبندی) میکنند، در حالی که انسجام موضوع را حفظ میکنند. ما چندین رویکرد را آزمایش کردیم و بر روی یک طرح تکه تکه شدن در سطح صفحه که به خوبی با قالب راهنمای رسانهها هماهنگ بود، قرار گرفتیم. ما از Amazon Kendra استفاده کردیم، که یک سرویس مدیریت شده است که از فهرست بندی اسناد مراقبت می کند، بدون نیاز به مشخصات جاسازی ها، در حالی که یک API آسان برای بازیابی ارائه می دهد. شکل زیر این معماری را نشان می دهد.

خط لوله یکپارچه و مقیاسپذیری که ما توسعه دادهایم به تور PGA اجازه میدهد تا تاریخچه کامل دادههای خود را که برخی از آنها به دهه 1800 برمیگردد، مقیاسبندی کند. این برنامههای کاربردی آینده را قادر میسازد که بتوانند در زمینه دوره حضور داشته باشند تا تجربیات غنی در زمان واقعی ایجاد کنند.

توسعه: ارزیابی LLM ها و توسعه برنامه های کاربردی هوش مصنوعی

ما LLMهای شخص اول و سوم موجود در Amazon Bedrock را به دقت آزمایش و ارزیابی کردیم تا مدلی را انتخاب کنیم که برای خط لوله و مورد استفاده ما مناسب است. ما Anthropic's Claude v2 و Claude Instant را در Amazon Bedrock انتخاب کردیم. برای خط لوله داده های ساختاریافته و بدون ساختار نهایی ما، مشاهده می کنیم که کلود 2 Anthropic در Amazon Bedrock نتایج کلی بهتری را برای خط لوله داده نهایی ما ایجاد کرد.

اعلان یک جنبه حیاتی برای واداشتن LLMها به خروجی متن دلخواه است. ما زمان قابل توجهی را صرف آزمایش با اعلان های مختلف برای هر یک از وظایف کردیم. به عنوان مثال، برای خط لوله متن به SQL، چندین اعلان بازگشتی داشتیم، با افزایش ویژگی و به تدریج طرحواره های جدول ساده شده. اگر یک پرس و جوی SQL نامعتبر بود و منجر به خطای آتنا می شد، ما یک اعلان تصحیح خطا ایجاد می کردیم که خطا و SQL نادرست را به LLM ارسال می کرد و از آن می خواست آن را برطرف کند. آخرین درخواست در خط لوله متن به SQL از LLM می خواهد که خروجی Athena را که می تواند در فرمت Markdown یا CSV ارائه شود، بگیرد و به کاربر پاسخ دهد. برای متن بدون ساختار، ما دستورات کلی را برای استفاده از زمینه بازیابی شده از آمازون کندرا برای پاسخ به سؤال کاربر ایجاد کردیم. این درخواست شامل دستورالعملهایی برای استفاده از اطلاعات بازیابیشده از آمازون کندرا و عدم تکیه بر دادههای پیشآموزش LLM بود.

تأخیر اغلب یک نگرانی در مورد برنامه های کاربردی هوش مصنوعی مولد است، و در اینجا نیز چنین است. به ویژه برای متن به SQL که نیاز به فراخوانی اولیه LLM نسل SQL و به دنبال آن فراخوانی LLM تولید پاسخ دارد، یک نگرانی است. اگر از یک LLM بزرگ مانند کلود V2 آنتروپیک استفاده می کنیم، این به طور موثر تاخیر تنها یک فراخوانی LLM را دو برابر می کند. ما چندین پیکربندی از LLMهای بزرگ و کوچکتر را برای ارزیابی زمان اجرا و همچنین صحت آزمایش کردیم. جدول زیر مثالی را برای یک سوال نشان می دهد که در زیر نشان داده شده است که تأخیر و همچنین پاسخ های ایجاد شده با Claude V2 و Claude Instant Anthropic را در Amazon Bedrock نشان می دهد.

نمونه اولیه

در برنامه خود، از یک تابع Lambda برای هماهنگ کردن انتخاب های سریع و ارتباط بین Amazon Athena، Amazon Kendra و Amazon Bedrock استفاده کردیم. این دستیار مجازی دارای یک رابط مکالمه است که با React و سیستم طراحی Cloudscape ساخته شده است که از متن و ویدیو برای تعامل با کاربران استفاده می کند.

دستیار مجازی ما می تواند طیف گسترده ای از سوالات را در مورد رویدادهای PGA TOUR، بازیکنان، آمار، تاریخچه و موارد دیگر مطرح کند. به عنوان مثال، وقتی از دستیار در مورد طولانیترین درایوهای تونی فیناو در مسابقات کودکان باز Shriners (یکی از رویدادهای Signature تور PGA) پرسیده شد، دستیار میتواند دادههای ساختاریافته را برای جمعآوری دادههای سطح شات خود جستجو کند. میتواند فاصله دقیق را بر حسب یارد، عدد دور و حفرهای که طی آن او به این رکورد دست یافته است را با استفاده از خط لوله متن به SQL استخراج کند. سپس دستیار این داده های عددی را برای ایجاد پاسخ نهایی تفسیر می کند. جدول زیر شامل چند نمونه پاسخ است.

| سوال | واکنش |

| طولانی ترین درایو تونی فیناو در مسابقات اوپن کودکان شرینرز چه بود؟ | طولانی ترین درایو تونی فیناو در مسابقات اوپن Shriners Childrens 382 یارد بود که در اولین راند در سوراخ شماره 4 در سال 2018 به آن ضربه زد. |

| طولانی ترین درایو توسط کولین موریکاوا در مسابقات باز کودکان Shriners چه بود؟ | طولانی ترین رانندگی کالین موریکاوا در مسابقات باز کودکان Shriners 334 یارد بود. این در سال 2019 در اولین دور در سوراخ شماره 15 رخ داد. |

| آیا کسی در مسابقات اپن کودکان Shriners 2022 تک خال ساخته است؟ | بله، آدام هادوین در دور سوم مسابقات باز کودکان Shriners 14 یک سوراخ در سوراخ 3 ایجاد کرد. |

ویدیوی توضیحی زیر چند نمونه از تعامل با دستیار مجازی را برجسته می کند.

در آزمایش اولیه، دستیار مجازی PGA TOUR ما در بهبود تجارب طرفداران نوید بسیار خوبی را نشان داده است. با ترکیب فناوریهای هوش مصنوعی مانند تبدیل متن به SQL، جستجوی معنایی و تولید زبان طبیعی، این دستیار پاسخهای آموزنده و جذابی را ارائه میدهد. طرفداران این قدرت را دارند که بدون زحمت به داده ها و روایت هایی دسترسی پیدا کنند که قبلاً یافتن آنها دشوار بود.

آینده چه چیزی را نگه می دارد؟

همانطور که توسعه را ادامه می دهیم، طیف سؤالاتی را که دستیار مجازی ما می تواند از عهده آنها برآید، گسترش خواهیم داد. این به آزمایش گسترده ای نیاز دارد، از طریق همکاری بین AWS و PGA TOUR. با گذشت زمان، هدف ما این است که دستیار را به یک تجربه شخصیشده و همهکاناله تبدیل کنیم که در رابطهای وب، تلفن همراه و صوتی قابل دسترسی است.

ایجاد یک دستیار هوش مصنوعی مولد مبتنی بر ابر به PGA TOUR این امکان را می دهد تا منبع داده گسترده خود را به چندین ذینفع داخلی و خارجی ارائه دهد. همانطور که چشم انداز هوش مصنوعی مولد ورزشی تکامل می یابد، امکان ایجاد محتوای جدید را فراهم می کند. برای مثال، میتوانید از هوش مصنوعی و یادگیری ماشینی (ML) استفاده کنید تا طرفداران محتوایی را که میخواهند هنگام تماشای یک رویداد ببینند، یا زمانی که تیمهای تولید به دنبال عکسهایی از تورنمنتهای قبلی هستند که با رویداد فعلی مطابقت دارند، مشاهده کنند. به عنوان مثال، اگر مکس هما در حال آماده شدن برای گرفتن آخرین شات خود در مسابقات قهرمانی PGA TOUR از نقطهای در فاصله 20 فوتی از پین باشد، PGA TOUR میتواند از هوش مصنوعی و ML برای شناسایی و ارائه کلیپهایی با نظرات تولید شده توسط هوش مصنوعی از او استفاده کند. قبلاً پنج بار اقدام به شلیک مشابه کرده بود. این نوع دسترسی و داده به یک تیم تولید اجازه می دهد تا فوراً به پخش ارزش اضافه کند یا به طرفداران اجازه دهد تا نوع داده ای را که می خواهند ببینند سفارشی کنند.

PGA TOUR پیشرو صنعت در استفاده از فناوری پیشرفته برای بهبود تجربه فن است. هوش مصنوعی در خط مقدم پشته فناوری ما قرار دارد، جایی که ما را قادر می سازد محیطی جذاب و تعاملی برای طرفداران ایجاد کنیم. این آغاز سفر هوش مصنوعی مولد ما با همکاری مرکز نوآوری هوش مصنوعی AWS برای یک تجربه مشتری نهایی تحولآفرین است. ما در تلاشیم تا از Amazon Bedrock و دادههای اختصاصی خود برای ایجاد یک تجربه تعاملی برای طرفداران PGA TOUR استفاده کنیم تا اطلاعات مورد علاقه در مورد یک رویداد، بازیکن، آمار یا سایر محتواها را به شیوهای تعاملی بیابند."

- اسکات گوترمن، معاون پخش و ویژگی های دیجیتال در PGA TOUR.

نتیجه

پروژهای که در این پست مورد بحث قرار گرفتیم نشان میدهد که چگونه منابع داده ساختاریافته و بدون ساختار را میتوان با استفاده از هوش مصنوعی برای ایجاد دستیارهای مجازی نسل بعدی ترکیب کرد. برای سازمانهای ورزشی، این فناوری تعامل بیشتر طرفداران را امکانپذیر میکند و بازده داخلی را باز میکند. اطلاعاتی که ما ارائه می کنیم به ذینفعان PGA TOUR مانند بازیکنان، مربیان، مقامات، شرکا و رسانه ها کمک می کند تا سریعتر تصمیم گیری کنند. فراتر از ورزش، روش شناسی ما می تواند در هر صنعتی تکرار شود. همین اصول برای دستیارهای ساختمانی که مشتریان، کارمندان، دانش آموزان، بیماران و سایر کاربران نهایی را درگیر می کنند، اعمال می شود. با طراحی و آزمایش متفکرانه، تقریباً هر سازمانی میتواند از یک سیستم هوش مصنوعی که پایگاههای داده، اسناد، تصاویر، ویدئوها و سایر محتواهای ساختاریافتهشان را زمینهای میکند، بهرهمند شود.

اگر علاقه مند به اجرای عملکردهای مشابه هستید، استفاده از آن را در نظر بگیرید نمایندگان آمازون بستر و پایگاه های دانش برای آمازون بستر به عنوان یک راه حل جایگزین و کاملاً مدیریت شده توسط AWS. این رویکرد میتواند ارائه اتوماسیون هوشمند و تواناییهای جستجوی دادهها را از طریق عوامل قابل تنظیم بیشتر بررسی کند. این عوامل به طور بالقوه می توانند تعاملات برنامه کاربر را به طبیعی تر، کارآمدتر و موثرتر تبدیل کنند.

درباره نویسندگان

اسکات گوترمن SVP عملیات دیجیتال برای تور PGA است. او مسئول عملیات کلی دیجیتال TOUR، توسعه محصول است و استراتژی GenAI آنها را هدایت می کند.

اسکات گوترمن SVP عملیات دیجیتال برای تور PGA است. او مسئول عملیات کلی دیجیتال TOUR، توسعه محصول است و استراتژی GenAI آنها را هدایت می کند.

احسان علی یک دانشمند کاربردی در مرکز نوآوری هوش مصنوعی آمازون است، جایی که با مشتریانی از حوزه های مختلف کار می کند تا مشکلات فوری و گران قیمت آنها را با استفاده از هوش مصنوعی مولد حل کند.

احسان علی یک دانشمند کاربردی در مرکز نوآوری هوش مصنوعی آمازون است، جایی که با مشتریانی از حوزه های مختلف کار می کند تا مشکلات فوری و گران قیمت آنها را با استفاده از هوش مصنوعی مولد حل کند.

تهین سید یک دانشمند کاربردی در مرکز نوآوری هوش مصنوعی آمازون است، جایی که با مشتریان برای کمک به تحقق نتایج کسب و کار با راه حل های هوش مصنوعی مولد کار می کند. در خارج از محل کار، او از امتحان غذاهای جدید، مسافرت و آموزش تکواندو لذت می برد.

تهین سید یک دانشمند کاربردی در مرکز نوآوری هوش مصنوعی آمازون است، جایی که با مشتریان برای کمک به تحقق نتایج کسب و کار با راه حل های هوش مصنوعی مولد کار می کند. در خارج از محل کار، او از امتحان غذاهای جدید، مسافرت و آموزش تکواندو لذت می برد.

گریس لنگ یک مهندس داده و ML با خدمات حرفه ای AWS است. گریس با اشتیاق برای غلبه بر چالش های سخت به مشتریان کمک می کند تا با توسعه راه حل های مبتنی بر یادگیری ماشین به اهداف خود برسند.

گریس لنگ یک مهندس داده و ML با خدمات حرفه ای AWS است. گریس با اشتیاق برای غلبه بر چالش های سخت به مشتریان کمک می کند تا با توسعه راه حل های مبتنی بر یادگیری ماشین به اهداف خود برسند.

جائه لی یک مدیر ارشد تعامل در ProServe's M&E vertical است. او مشارکتهای پیچیده را رهبری و ارائه میکند، مجموعههای مهارت حل مسئله قوی را نشان میدهد، انتظارات ذینفعان را مدیریت میکند، و ارائههای سطح اجرایی را مدیریت میکند. او از کار بر روی پروژه های متمرکز بر ورزش، هوش مصنوعی مولد و تجربه مشتری لذت می برد.

جائه لی یک مدیر ارشد تعامل در ProServe's M&E vertical است. او مشارکتهای پیچیده را رهبری و ارائه میکند، مجموعههای مهارت حل مسئله قوی را نشان میدهد، انتظارات ذینفعان را مدیریت میکند، و ارائههای سطح اجرایی را مدیریت میکند. او از کار بر روی پروژه های متمرکز بر ورزش، هوش مصنوعی مولد و تجربه مشتری لذت می برد.

کارن چهار یک مشاور امنیتی با تیم تحویل مشترک در AWS است. او یک علاقهمند به فناوری است که از همکاری با مشتریان برای حل چالشهای امنیتی آنها و بهبود وضعیت امنیتی آنها در فضای ابری لذت میبرد.

کارن چهار یک مشاور امنیتی با تیم تحویل مشترک در AWS است. او یک علاقهمند به فناوری است که از همکاری با مشتریان برای حل چالشهای امنیتی آنها و بهبود وضعیت امنیتی آنها در فضای ابری لذت میبرد.

مایک امجدی یک مهندس داده و ML با AWS ProServe است که بر روی توانمندسازی مشتریان برای به حداکثر رساندن ارزش داده ها متمرکز شده است. او در طراحی، ساخت و بهینه سازی خطوط لوله داده با رعایت اصولی که به خوبی طراحی شده اند، تخصص دارد. مایک مشتاق استفاده از فناوری برای حل مشکلات است و متعهد به ارائه بهترین نتایج برای مشتریان خود است.

مایک امجدی یک مهندس داده و ML با AWS ProServe است که بر روی توانمندسازی مشتریان برای به حداکثر رساندن ارزش داده ها متمرکز شده است. او در طراحی، ساخت و بهینه سازی خطوط لوله داده با رعایت اصولی که به خوبی طراحی شده اند، تخصص دارد. مایک مشتاق استفاده از فناوری برای حل مشکلات است و متعهد به ارائه بهترین نتایج برای مشتریان خود است.

ورشالی ساوانت یک مهندس Front End با Proserve است. او در ایجاد وب سایت های واکنش گرا مهارت بالایی دارد. او عاشق کار با مشتریان، درک نیازهای آنها و ارائه راه حل های مقیاس پذیر و آسان برای استفاده از UI/UX است.

ورشالی ساوانت یک مهندس Front End با Proserve است. او در ایجاد وب سایت های واکنش گرا مهارت بالایی دارد. او عاشق کار با مشتریان، درک نیازهای آنها و ارائه راه حل های مقیاس پذیر و آسان برای استفاده از UI/UX است.

نیلم پاتل مدیر راهحلهای مشتری در AWS است که پیشروی ابتکارات کلیدی هوش مصنوعی و نوسازی ابری است. Neelam با مدیران کلیدی و صاحبان فناوری برای رسیدگی به چالشهای تبدیل ابر خود همکاری میکند و به مشتریان کمک میکند تا مزایای پذیرش ابر را به حداکثر برسانند. او دارای مدرک MBA از مدرسه بازرگانی وارویک، انگلستان و لیسانس مهندسی کامپیوتر، هند است.

نیلم پاتل مدیر راهحلهای مشتری در AWS است که پیشروی ابتکارات کلیدی هوش مصنوعی و نوسازی ابری است. Neelam با مدیران کلیدی و صاحبان فناوری برای رسیدگی به چالشهای تبدیل ابر خود همکاری میکند و به مشتریان کمک میکند تا مزایای پذیرش ابر را به حداکثر برسانند. او دارای مدرک MBA از مدرسه بازرگانی وارویک، انگلستان و لیسانس مهندسی کامپیوتر، هند است.

دکتر مورعلی بطا معمار راه حل گلف جهانی در AWS است و ابتکارات محوری شامل هوش مصنوعی، تجزیه و تحلیل داده ها و فناوری های ابری پیشرفته را رهبری می کند. مورالی با مدیران کلیدی و صاحبان فناوری کار می کند تا چالش های تجاری مشتری را درک کند و راه حل هایی برای مقابله با این چالش ها طراحی کند. او دارای مدرک MBA در رشته مالی از UConn و دکترا از دانشگاه ایالتی آیووا است.

دکتر مورعلی بطا معمار راه حل گلف جهانی در AWS است و ابتکارات محوری شامل هوش مصنوعی، تجزیه و تحلیل داده ها و فناوری های ابری پیشرفته را رهبری می کند. مورالی با مدیران کلیدی و صاحبان فناوری کار می کند تا چالش های تجاری مشتری را درک کند و راه حل هایی برای مقابله با این چالش ها طراحی کند. او دارای مدرک MBA در رشته مالی از UConn و دکترا از دانشگاه ایالتی آیووا است.

مهدی نور مدیر علوم کاربردی در Generative Ai Innovation Center است. او با اشتیاق به پل زدن فناوری و نوآوری، به مشتریان AWS در بازگشایی پتانسیل هوش مصنوعی مولد کمک میکند، چالشهای بالقوه را به فرصتهایی برای آزمایش و نوآوری سریع با تمرکز بر استفادههای مقیاسپذیر، قابل اندازهگیری و تأثیرگذار از فناوریهای هوش مصنوعی پیشرفته تبدیل میکند و مسیر را سادهسازی میکند. به تولید.

مهدی نور مدیر علوم کاربردی در Generative Ai Innovation Center است. او با اشتیاق به پل زدن فناوری و نوآوری، به مشتریان AWS در بازگشایی پتانسیل هوش مصنوعی مولد کمک میکند، چالشهای بالقوه را به فرصتهایی برای آزمایش و نوآوری سریع با تمرکز بر استفادههای مقیاسپذیر، قابل اندازهگیری و تأثیرگذار از فناوریهای هوش مصنوعی پیشرفته تبدیل میکند و مسیر را سادهسازی میکند. به تولید.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/the-journey-of-pga-tours-generative-ai-virtual-assistant-from-concept-to-development-to-prototype/