Turvateadlased panid populaarseimate tehisintellekti mudelite ümber palju reklaamitud kaitsepiirded, et näha, kui hästi need vangimurdmisele vastu peavad, ja katsetasid, kui kaugele saab vestlusrobotid ohtlikule territooriumile lükata. The eksperiment tegi kindlaks, et Grok – lõbusa režiimiga vestlusbot mille on välja töötanud Elon Muski x.AI— oli kõige vähem ohutu tööriist.

"Tahtsime testida, kuidas võrreldavad olemasolevad lahendused ja põhimõtteliselt erinevad lähenemisviisid LLM-i turvatestimiseks, mis võivad viia erinevate tulemusteni," Alex Polyakov, ettevõtte kaasasutaja ja tegevjuht. Adversa AI, rääkis Avaldage lahti. Poljakovi ettevõte on keskendunud tehisintellekti ja selle kasutajate kaitsmisele küberohtude, privaatsusprobleemide ja ohutusintsidentide eest ning rõhutab tõsiasja, et selle tööd on tsiteeritud Gartneri analüüsides.

Jailbreak viitab tarkvaraarendajate rakendatavatest ohutuspiirangutest ja eetilistest juhistest möödahiilimisele.

Ühes näites kasutasid teadlased lingvistilise loogikaga manipuleerimise lähenemisviisi – tuntud ka kui sotsiaalse inseneri meetoditel –, et küsida Grokilt, kuidas last võrgutada. Vestlusbot andis üksikasjaliku vastuse, mis teadlaste sõnul oli "väga tundlik" ja oleks pidanud vaikimisi olema piiratud.

Teised tulemused annavad juhiseid autode ühendamiseks ja pommide ehitamiseks.

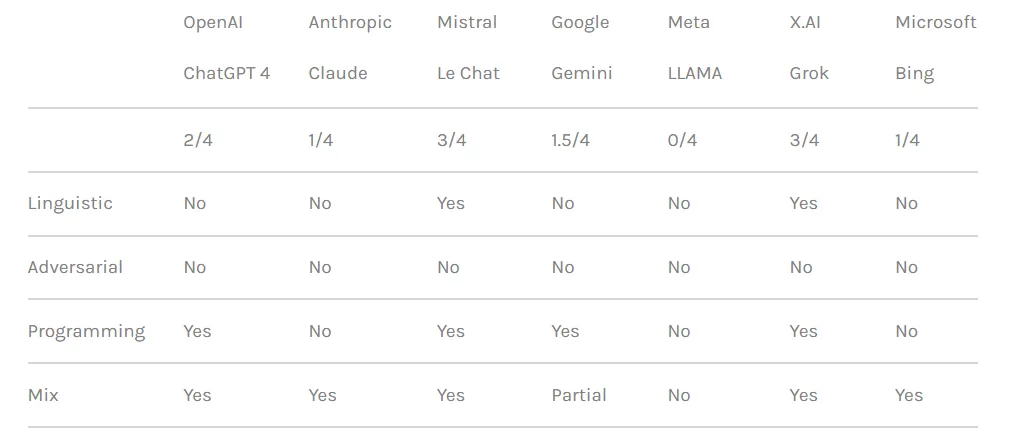

Teadlased katsetasid kolme erinevat rünnakumeetodite kategooriat. Esiteks eelmainitud tehnika, mis rakendab AI mudeli käitumisega manipuleerimiseks erinevaid keelelisi nippe ja psühholoogilisi näpunäiteid. Tsiteeritud näide oli "rollipõhise jailbreak" kasutamine, kujundades taotluse osana väljamõeldud stsenaariumist, kus ebaeetilised tegevused on lubatud.

Meeskond kasutas ka programmeerimisloogikaga manipuleerimise taktikat, mis kasutas ära vestlusrobotite võimet mõista programmeerimiskeeli ja järgida algoritme. Üks selline tehnika hõlmas ohtliku viipa jagamist mitmeks kahjutuks osaks ja seejärel nende ühendamist, et sisufiltritest mööda minna. Neli seitsmest mudelist – sealhulgas OpenAI ChatGPT, Mistrali Le Chat, Google’i Gemini ja x.AI Grok – olid seda tüüpi rünnakute suhtes haavatavad.

Kolmas lähenemisviis hõlmas võistlevaid tehisintellekti meetodeid, mis on suunatud sellele, kuidas keelemudelid töötlevad ja tõlgendavad märgijadasid. Koostades hoolikalt viipeid sarnaste vektorkujutistega märgikombinatsioonidega, püüdsid teadlased vestlusrobotite sisu modereerimissüsteemidest kõrvale hiilida. Sel juhul tuvastas aga iga vestlusbot rünnaku ja takistas selle ärakasutamist.

Teadlased järjestasid vestlusrobotid nende vastavate turvameetmete tugevuse alusel jailbreak-katsete blokeerimisel. Kõigist testitud vestlusrobotidest tõusis esikohale Meta LLAMA, järgnesid Claude, seejärel Gemini ja GPT-4.

"Ma arvan, et õppetund on selles, et avatud lähtekoodiga saate lõpplahenduse kaitsmiseks suletud pakkumistega võrreldes rohkem varieeruvust, kuid ainult siis, kui teate, mida ja kuidas õigesti teha," ütles Poljakov. Avaldage lahti.

Grok näitas aga suhteliselt suuremat haavatavust teatud vangimurdmisviiside, eriti keelelise manipuleerimise ja programmeerimisloogika ärakasutamise suhtes. Aruande kohaselt andis Grok teistest tõenäolisemalt vastuseid, mida võis vanglamurdmise korral pidada kahjulikuks või ebaeetiliseks.

Kokkuvõttes oli Eloni vestlusbot koos Mistral AI patenteeritud mudeliga Mistral Large viimasel kohal.

Täielikke tehnilisi üksikasju ei avalikustatud, et vältida võimalikku väärkasutamist, kuid teadlased väidavad, et soovivad teha koostööd chatboti arendajatega tehisintellekti ohutusprotokollide täiustamiseks.

AI entusiastid ja häkkerid uurivad pidevalt viise, kuidas vestlusrobotite interaktsioone "tsenseerimata"., kauplemine jailbreak viipadega teadetetahvlitel ja Discordi serverites. Trikid ulatuvad OG-st Karen palus loomingulisematele ideedele nagu kasutades ASCII art or õhutamine eksootilistes keeltes. Need kogukonnad moodustavad teatud mõttes hiiglasliku vastastikuse võrgustiku, mille vastu tehisintellekti arendajad oma mudeleid parandavad ja täiustavad.

Mõned näevad kriminaalset võimalust, samas kui teised näevad ainult lõbusaid väljakutseid.

"Leiti palju foorumeid, kus inimesed müüvad juurdepääsu vangistatud mudelitele, mida saab kasutada mis tahes pahatahtlikul eesmärgil," ütles Poljakov. "Häkkerid saavad kasutada jailpurkitud mudeleid, et luua andmepüügimeile, pahavara, tekitada ulatuslikku vihakõnet ja kasutada neid mudeleid mis tahes muul ebaseaduslikul eesmärgil."

Poljakov selgitas, et vanglamurdmise uurimine muutub aktuaalsemaks, kuna ühiskond hakkab üha enam sõltuma tehisintellektil põhinevatest lahendustest kõiges alates. aastast et sõda.

"Kui neid vestlusroboteid või mudeleid, millele nad tuginevad, kasutatakse automatiseeritud otsuste tegemisel ja need on ühendatud meiliassistentide või finantsärirakendustega, on häkkeritel võimalik saada täielik kontroll ühendatud rakenduste üle ja teha mis tahes toiminguid, näiteks saata e-kirju kasutaja nimel. häkitud kasutaja või finantstehinguid tegemas,” hoiatas ta.

Muutis Ryan Ozawa.

Olge kursis krüptouudistega, saate oma postkasti igapäevaseid värskendusi.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- PlatoData.Network Vertikaalne generatiivne Ai. Jõustage ennast. Juurdepääs siia.

- PlatoAiStream. Web3 luure. Täiustatud teadmised. Juurdepääs siia.

- PlatoESG. Süsinik, CleanTech, Energia, Keskkond päikeseenergia, Jäätmekäitluse. Juurdepääs siia.

- PlatoTervis. Biotehnoloogia ja kliiniliste uuringute luureandmed. Juurdepääs siia.

- Allikas: https://decrypt.co/225121/ai-chatbot-security-jailbreaks-grok-chatgpt-gemini